Approuvé le 12 décembre 2025, un rapport fédéral décrit l’IA comme un accélérateur : attaques plus fréquentes, deepfakes plus crédibles mais aussi détection et réponse renforcées.

TL;DR : L’essentiel

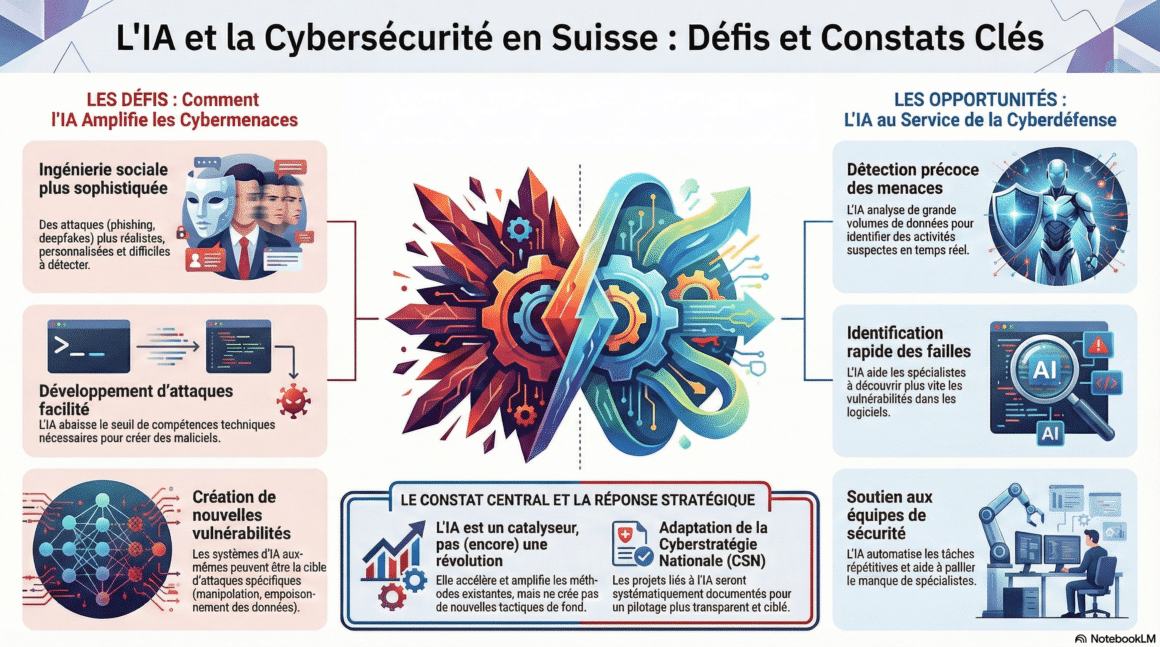

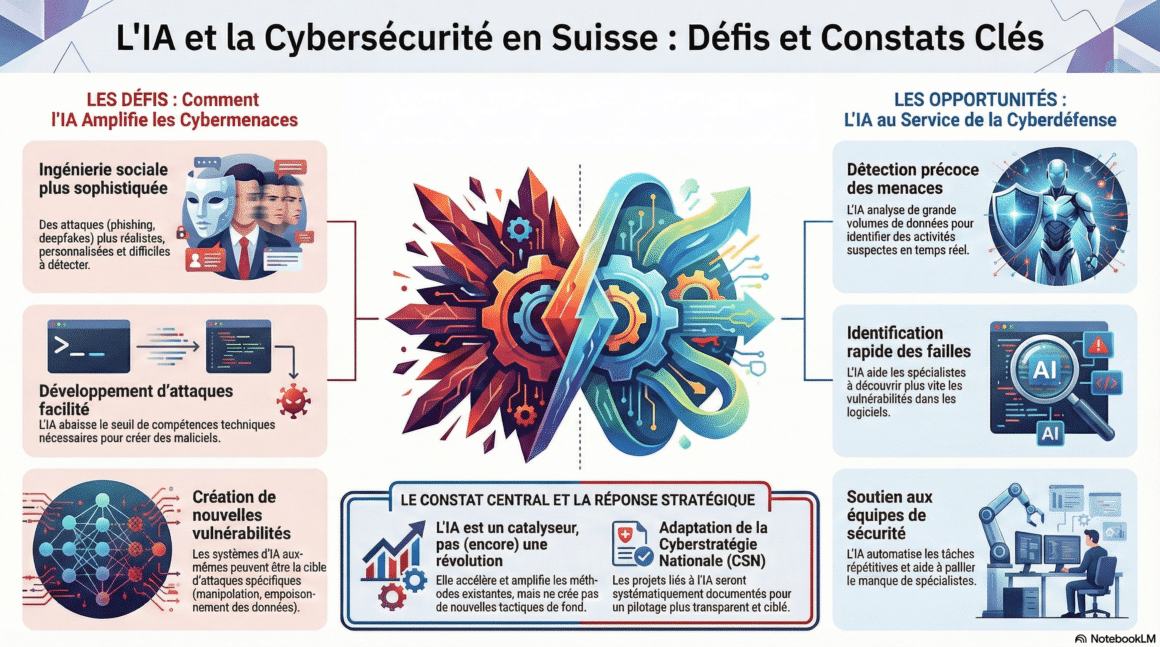

- Le rapport suisse sur l’impact de l’intelligence artificielle sur la cybersécurité n’est pas une révolution future mais un accélérateur pour les cybermenaces et les défenses.

- Le Conseil fédéral conclut que l’IA catalyse les cyber-tendances, augmentant la quantité et la qualité des attaques sans encore créer de méthodes entièrement nouvelles, mais en intensifiant considérablement le risque.

- L’intelligence artificielle renforce massivement les menaces d’ingénierie sociale, permettant la création de campagnes de hameçonnage et de deepfakes ultra-réalistes et personnalisés avec une facilité déconcertante pour les cybercriminels.

- Face à ces risques, l’IA représente aussi une opportunité majeure pour la cyberdéfense, notamment en accélérant la détection des menaces et des vulnérabilités, soulageant ainsi les équipes de sécurité surchargées.

Un nouveau rapport du Conseil fédéral, approuvé le 12 décembre 2025, révèle que l’intelligence artificielle arme simultanément les cybercriminels d’outils sophistiqués et dote les défenseurs de nouveaux boucliers renforcés. Cette technologie, en pleine démocratisation, intensifie la complexité et la fréquence des menaces à un rythme inédit, forçant la Confédération à une réévaluation stratégique de ses mécanismes de défense. Le document, qui répond à une interpellation parlementaire, analyse en profondeur les opportunités et les risques de l’IA, tout en examinant l’adéquation de la Cyberstratégie nationale (CSN) face à cette évolution technologique fulgurante.

L’IA, une arme à double tranchant pour la cybersécurité

Comme le rapporte ce document, l’intelligence artificielle modifie l’équilibre des forces dans le cyberespace. Agissant comme un puissant accélérateur, elle dote les attaquants d’outils plus performants et plus accessibles, tout en offrant aux défenseurs de nouvelles capacités pour contrer des menaces de plus en plus sophistiquées. Cette dualité impose une compréhension fine de ses applications, tant offensives que défensives, qui redéfinissent déjà les contours du champ de bataille numérique.

L’impact le plus immédiat et significatif de l’IA se manifeste dans le domaine de l’ingénierie sociale, une technique de manipulation psychologique visant à extorquer des informations ou des fonds. L’IA générative et les grands modèles de langage (LLM) permettent désormais à des acteurs malveillants de créer des campagnes d’hameçonnage (phishing par courriel), de vishing (par téléphone) et de smishing (par SMS) d’un réalisme jamais connu jusqu’à présent. Ces messages, personnalisés et linguistiquement impeccables, peuvent être produits en masse dans de multiples langues, y compris en suisse allemand, ce qui abaisse considérablement la barrière technique pour les cybercriminels. L’un des exemples les plus alarmants est la prolifération des deepfakes — des contenus audiovisuels hyperréalistes générés par IA. Ces derniers peuvent être utilisés pour usurper l’identité de dirigeants dans des fraudes au président ou, comme ce fut le cas en Suisse, pour créer de fausses publicités où des personnalités publiques semblent promouvoir des plateformes d’investissement frauduleuses, rendant la distinction entre le vrai et le faux de plus en plus ardue pour le citoyen moyen.

L'essentiel Cybersécurité, IA & Tech

Rejoignez la communauté. 3 fois par semaine, recevez l'analyse des tendances par Marc Barbezat. Pas de spam, juste de l'info.

Alors que l’ingénierie sociale représente le front le plus visible de ce nouveau conflit, l’influence corrosive de l’IA s’étend profondément dans les fondements techniques de la cybersécurité. Elle simplifie et automatise de nombreuses autres activités malveillantes, abaissant le seuil de compétences requis pour lancer des attaques complexes. L’IA est utilisée pour scanner les logiciels à grande échelle à la recherche de vulnérabilités, y compris les failles zero-day, qui sont des brèches de sécurité encore inconnues du développeur et pour lesquelles aucun correctif n’existe. De plus, elle facilite le développement et le camouflage de logiciels malveillants, ou malwares — des programmes conçus pour nuire à un système informatique —, en modifiant leur code pour échapper aux systèmes de détection traditionnels. Le rapport du Conseil fédéral souligne toutefois une nuance importante : bien que l’IA rende les méthodes d’attaque existantes plus efficaces, elle n’a pas encore permis de créer des tactiques, techniques et procédures (TTP) entièrement nouvelles. Les attaques totalement autonomes ne sont pas jugées imminentes, car une expertise humaine reste indispensable pour guider les outils d’IA et orchestrer les opérations complexes.

📚 Ce podcast repose sur une recherche et une analyse menées par mes soins à partir de sources ouvertes et spécialisées. Il a ensuite été réalisé avec l’aide de NotebookLM, l’outil d’intelligence artificielle développé par Google.

🎧 Ce podcast revient sur le rapport fédéral « Opportunités et risques des systèmes d’intelligence artificielle dans la cybersécurité », rédigé à la suite du postulat 23.3861 Andrey et approuvé par le Conseil fédéral le 12 décembre 2025. Le document décrit une IA qui n’invente pas une cybersécurité entièrement nouvelle, mais accélère fortement les tendances déjà à l’œuvre, côté attaque comme côté défense.

L’intégration croissante de l’IA au sein des systèmes informatiques des entreprises crée également de nouvelles surfaces d’attaque et des vulnérabilités inédites. La complexité de ces systèmes rend leur surveillance difficile, ouvrant la voie à des manipulations subtiles. Une menace émergente est l’empoisonnement de données (data poisoning), une technique où un attaquant introduit des informations corrompues lors de la phase d’entraînement d’un modèle pour en altérer le comportement futur à des fins malveillantes. Une autre méthode consiste à dissimuler des portes dérobées (backdoors) dans des modèles d’IA open source largement partagés, infectant potentiellement des milliers d’utilisateurs. Enfin, le rapport met en lumière la dépendance stratégique croissante envers un petit nombre de fournisseurs dominants de technologies d’IA, ce qui soulève des questions de souveraineté numérique et de résilience nationale en cas de tensions géopolitiques ou de défaillance d’un acteur majeur.

La Suisse face au défi : entre cyberdéfense augmentée et stratégie nationale

Face à cette menace amplifiée, la Suisse ne reste pas passive. Les mêmes technologies qui arment les cybercriminels sont activement mises à profit pour renforcer la cyberdéfense nationale. Cette course technologique s’accompagne d’une adaptation stratégique visant à intégrer l’IA de manière cohérente et transparente dans l’écosystème de sécurité national.

Pour les cyberdéfenseurs, l’IA est devenue un allié indispensable dans les tranchées. Elle est utilisée pour détecter automatiquement les contenus frauduleux, y compris les deepfakes, et pour identifier les vulnérabilités dans le code logiciel dès la phase de développement. Au sein des centres opérationnels de sécurité (SOC), l’IA joue un rôle crucial en automatisant le triage des milliers d’alertes de sécurité quotidiennes. Cette automatisation permet de hiérarchiser les menaces, de réduire la « fatigue liée aux alertes » — un phénomène où les analystes humains, submergés, peuvent manquer des incidents critiques — et de libérer du temps pour des tâches à plus haute valeur ajoutée. Ces opérations sont encore améliorées par les plateformes SOAR (Security Orchestration, Automation and Response), qui utilisent l’IA pour déclencher des réponses automatisées à des incidents connus, accélérant ainsi la neutralisation des attaques. Le rapport insiste cependant sur le fait que l’IA est un outil de soutien qui augmente les capacités des experts humains, mais ne les remplace pas.

La réponse stratégique de la Suisse s’articule autour de sa Cyberstratégie nationale. Conçue pour être technologiquement agnostique, la CSN offre un cadre flexible capable de s’adapter aux évolutions rapides comme celle de l’IA. Cependant, le rapport du Conseil fédéral conclut que cette approche, bien que pertinente, nécessite des ajustements pour garantir une meilleure visibilité et coordination. Pour combattre une fragmentation croissante des efforts, le Conseil fédéral a donc mandaté l’Office fédéral de la cybersécurité (OFCS) pour créer un inventaire complet de tous les projets de cybersécurité liés à l’IA, répondant ainsi à un manque critique de vue d’ensemble stratégique identifié dans le rapport. Par ailleurs, la Suisse met en place une réponse à plusieurs niveaux, combinant la recherche nationale de pointe, via son Cyber-Defence Campus d’armasuisse, avec une diplomatie internationale proactive. Cette dernière se manifeste par son leadership dans des initiatives comme le réseau ICAIN pour une IA responsable et par son projet d’accueillir un sommet mondial sur l’IA à Genève, positionnant le pays comme un acteur clé dans la gouvernance mondiale de cette technologie.

L’intelligence artificielle est un puissant catalyseur qui accélère le rythme et la complexité de la cybersécurité, en amplifiant simultanément les risques et les capacités de défense. Elle ne représente pas une rupture fondamentale avec le passé, mais plutôt une intensification des dynamiques existantes. L’adaptation stratégique de la Suisse, qui privilégie la transparence, la coordination et l’évaluation continue au sein de sa Cyberstratégie nationale, témoigne d’une approche proactive pour naviguer dans ce paysage technologique en constante évolution. En fin de compte, la stratégie du Conseil fédéral reconnaît une vérité difficile : à l’ère de l’IA, l’immobilisme n’est pas une option. La posture de cybersécurité de la Suisse sera désormais définie par sa capacité à s’adapter et à innover plus vite que ses adversaires.

Cette veille vous est utile ?

Offrez un café pour soutenir le serveur (et le rédacteur).