Les agents IA gagnent en autonomie et accès système. Une évolution utile, mais qui expose à de nouveaux risques liés à l’exécution et l’interconnexion des données.

En bref

- Des agents peuvent exécuter du code à partir de commandes dites « sûres » lorsqu’ils reçoivent des paramètres inattendus.

- Sur mobile, des assistants peuvent accéder à des messages ou des notifications si certaines autorisations restent activées par défaut.

- De nouveaux services simplifient l’accès des agents à des données fiables, ce qui améliore la qualité de leur travail.

- Mais ces interconnexions peuvent être détournées pour transférer des informations sensibles, parfois sans alerte visible.

Les agents d’intelligence artificielle ne se limitent plus à répondre à des questions. Ils ouvrent des fichiers, explorent des répertoires, lancent des tests et interagissent avec des applications. Ce gain de productivité rapproche toutefois l’IA de zones sensibles : postes de travail, dépôts de code, messageries. Le risque ne réside plus seulement dans une réponse erronée, mais dans la capacité d’action que l’on confie à l’agent et dans les connexions qu’il agrège.

Cet article explique ce qui change pour le risque, comment des détournements concrets se produisent via des commandes « sûres », et pourquoi l’interconnexion croissante appelle des garde‑fous simples et visibles.

Ce qui change avec les agents IA : une autonomie qui modifie le périmètre du risque

Autrefois, chaque action technique passait par un humain : ouvrir un terminal, lancer une commande, vérifier un résultat. Désormais, une demande en langage naturel peut déclencher une suite d’opérations locales — recherche de fichiers, exécution de tests, lecture de dépôts — sans intervention immédiate. Cette autonomie réduit le temps entre l’intention et l’effet, et transforme l’agent en un acteur technique capable de modifier un état système.

L'essentiel Cybersécurité, IA & Tech

Rejoignez la communauté. 3 fois par semaine, recevez l'analyse des tendances par Marc Barbezat. Pas de spam, juste de l'info.

La vitesse d’exécution est un autre facteur. Une chaîne d’opérations peut s’enchaîner en quelques secondes : l’agent invoque un outil, enchaîne sur une analyse, écrit un fichier, relance un test. Ce rythme complique la détection humaine et les systèmes d’alerte classiques, qui n’ont pas été conçus pour suivre des séries d’appels automatisés aussi rapides.

Enfin, l’interconnexion entre outils augmente la surface d’exposition. Recherche de contenu, gestion de versions et automatisation de builds étaient autrefois des silos ; les agents les relient et créent des chemins nouveaux par lesquels des données ou des commandes peuvent circuler. Comme le montrent les travaux de Trail of Bits, cette proximité avec le système ouvre des chemins inattendus que des filtres superficiels ne suffisent pas à neutraliser. (Trail of Bits)

Un guide pratique et accessible à tous pour les dirigeants d’entreprise, les entrepreneurs et les esprits curieux. « Les agents (…) sont à l’origine de la plus grande révolution informatique depuis le passage de la saisie de commandes au simple clic sur des icônes. » — Bill Gates. « Les agents IA deviendront notre principal mode d’interaction avec les ordinateurs. » — Satya Nadella

🛒 Le lien ci-dessus est affilié : en commandant via ce lien, vous soutenez la veille DCOD sans frais supplémentaires 🙏

Comment les détournements se produisent : des commandes « sûres » qui ne le sont pas toujours

Les agents s’appuient sur des utilitaires éprouvés (find, ripgrep, git, go test) pour gagner en performance et fiabilité. Le péril surgit quand la protection se limite à une allowlist de commandes sans validation stricte des arguments : un drapeau ou une option inattendue peut changer complètement le comportement d’un binaire.

Des cas concrets illustrent ce mécanisme. L’option -exec d’un outil de test peut être détournée pour exécuter un binaire arbitraire ; la combinaison git show (qui peut écrire une sortie formatée dans un fichier) suivi de ripgrep --pre (qui exécute un programme sur les résultats) permet de créer puis d’exécuter un contenu malveillant. Ces enchaînements montrent que l’exploitation passe par la composition des paramètres, pas par une commande « interdite » explicite.

Pour réduire ce risque, plusieurs mesures techniques convergent : isoler l’agent dans une boite de test (sandbox) pour limiter l’impact des exécutions, séparer strictement options et paramètres (par exemple en utilisant --), interdire l’exécution via une interprétation shell, et exiger une validation humaine lorsque des opérations créent, modifient ou exécutent des fichiers. La journalisation fine des arguments et la détection d’enchaînements inhabituels complètent ce dispositif.

Comprendre l’interconnexion : simplifier l’accès, oui, mais avec contrôle

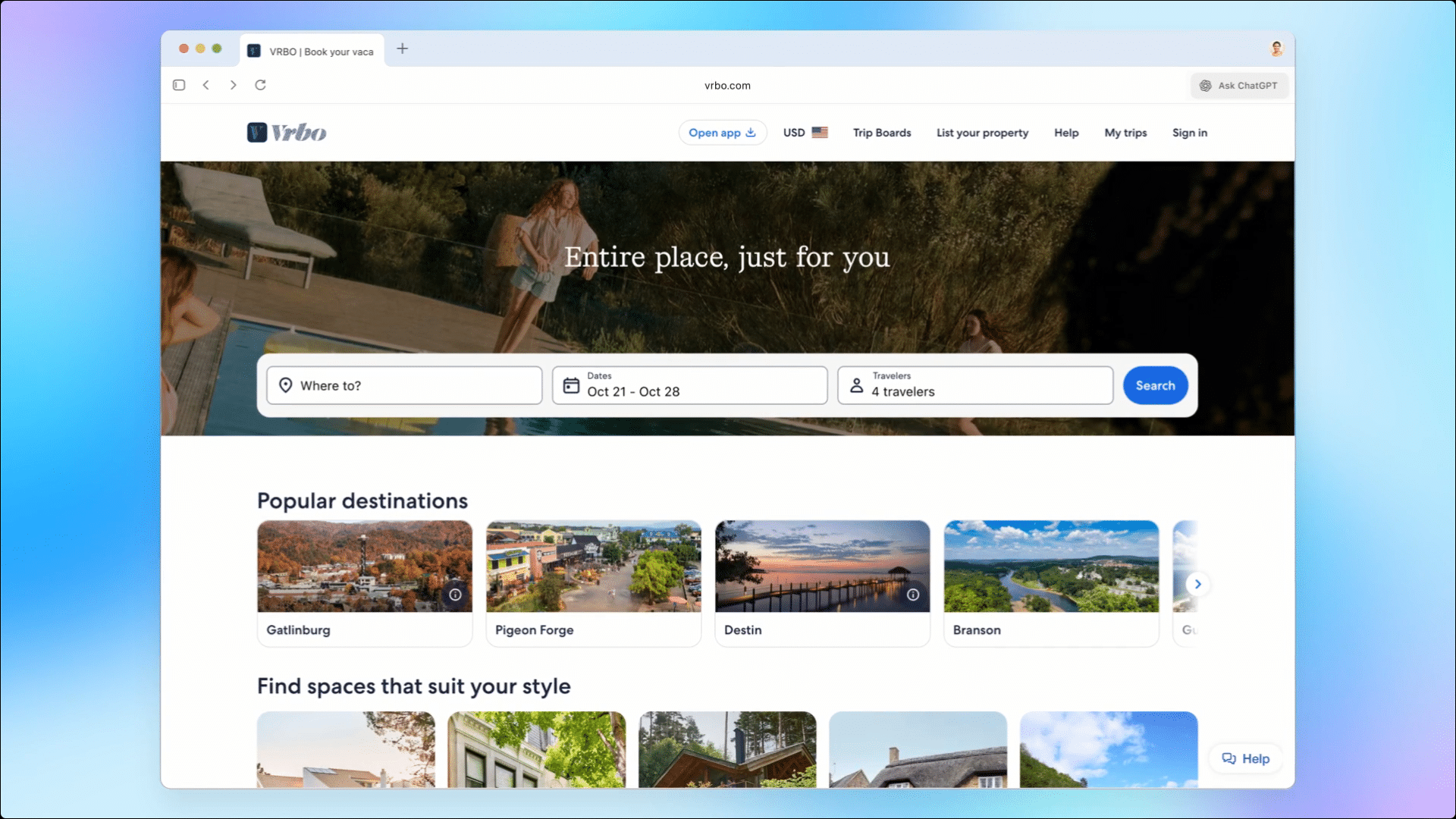

Sur mobile, des assistants peuvent lire, résumer ou composer des messages selon des réglages parfois activés par défaut. Ces intégrations brouillent la maîtrise de ce qui est envoyé ou stocké : il est important d’auditer les autorisations aux applications, aux notifications et aux historiques pour éviter des partages involontaires, comme le recommande l’Electronic Frontier Foundation dans son analyse. (EFF)

Parallèlement, des services facilitent l’accès à des jeux de données publics et structurés pour améliorer la qualité des réponses des agents. Cette simplification est utile : elle réduit les hallucinations et accélère les développements. Le défi apparaît quand ces ponts permettent aussi la découverte automatique de données sensibles et leur transfert entre environnements.

Une menace documentée illustre ce risque : une chaîne d’attaque « zéro‑clic » utilisant des connexions de confiance pour localiser puis exfiltrer des données sans interaction humaine visible. Ce scénario rappelle que la facilité d’accès doit être compensée par des garde‑fous opérationnels : segmentation des droits, allow‑listing des destinations et surveillance des flux d’export. . Comme le détaille le projet Data Commons dans Google Developers Blog. Une analyse relayée par Yahoo Finance décrit également une attaque « zéro‑clic » exploitant ces interconnexions.)

Une autonomie utile mais qui demande du cadrage

Les agents IA transforment la manière dont les actions techniques sont réalisées : ils exécutent, enchaînent et coordonnent des opérations à la vitesse d’un système automatisé, tout en s’appuyant sur des outils du quotidien. Le risque n’apparaît pas parce qu’ils « pensent » ou « décident », mais parce qu’ils disposent désormais d’une capacité d’action qui était autrefois strictement humaine.

Cette capacité repose sur trois facteurs clés : la portée des environnements auxquels l’agent accède (fichiers, dépôts, messageries), la rapidité d’exécution des chaînes d’opérations, et l’étendue des autorisations accordées par défaut ou par commodité. Plus ces trois dimensions s’élargissent, plus un simple prompt, une règle ou une intégration peut devenir un vecteur d’impact.

Pour tirer pleinement parti de ces agents tout en préservant des environnements critiques, trois réflexes structurants s’imposent : donner des permissions minimales par défaut, isoler l’exécution dans des environnements délimités, et rendre chaque action traçable et observable en temps réel. Ces choix ne ralentissent pas l’innovation : ils permettent de la rendre soutenable.

A lire aussi

Agents IA dérivants : la menace du « trafic d’agents de session »

Une nouvelle attaque permet à un agent IA malveillant d’injecter des instructions cachées au cœur de conversations entre agents collaborant via le protocole A2A.

Atlas d’OpenAI : un navigateur IA qui inquiète sur la sécurité et la vie privée

Les fonctions d’automatisation et de mémoire d’Atlas soulèvent des inquiétudes sur le stockage des données et les attaques par injection de commandes.

Serveurs, API, temps de veille...

DCOD est indépendant et sans revenus. Soutenez le site pour l'aider à couvrir ses frais techniques.