Une faille critique permet d’exploiter ChatGPT, Gemini et d’autres IA via des extensions, exposant entreprises et utilisateurs à des fuites de données invisibles.

L’intégration croissante de l’intelligence artificielle dans les outils du quotidien s’accompagne de nouveaux risques peu explorés. La recherche de LayerX met en lumière un vecteur d’attaque encore largement ignoré : les extensions de navigateur. En exploitant leur capacité à interagir avec le contenu d’une page web, certaines extensions peuvent manipuler directement les champs de saisie des assistants IA basés sur des LLM (modèles de langage), sans demander de permissions spécifiques. Ce constat interpelle, car il suggère que n’importe quel outil IA accessible via navigateur pourrait devenir un complice involontaire d’opérations malveillantes.

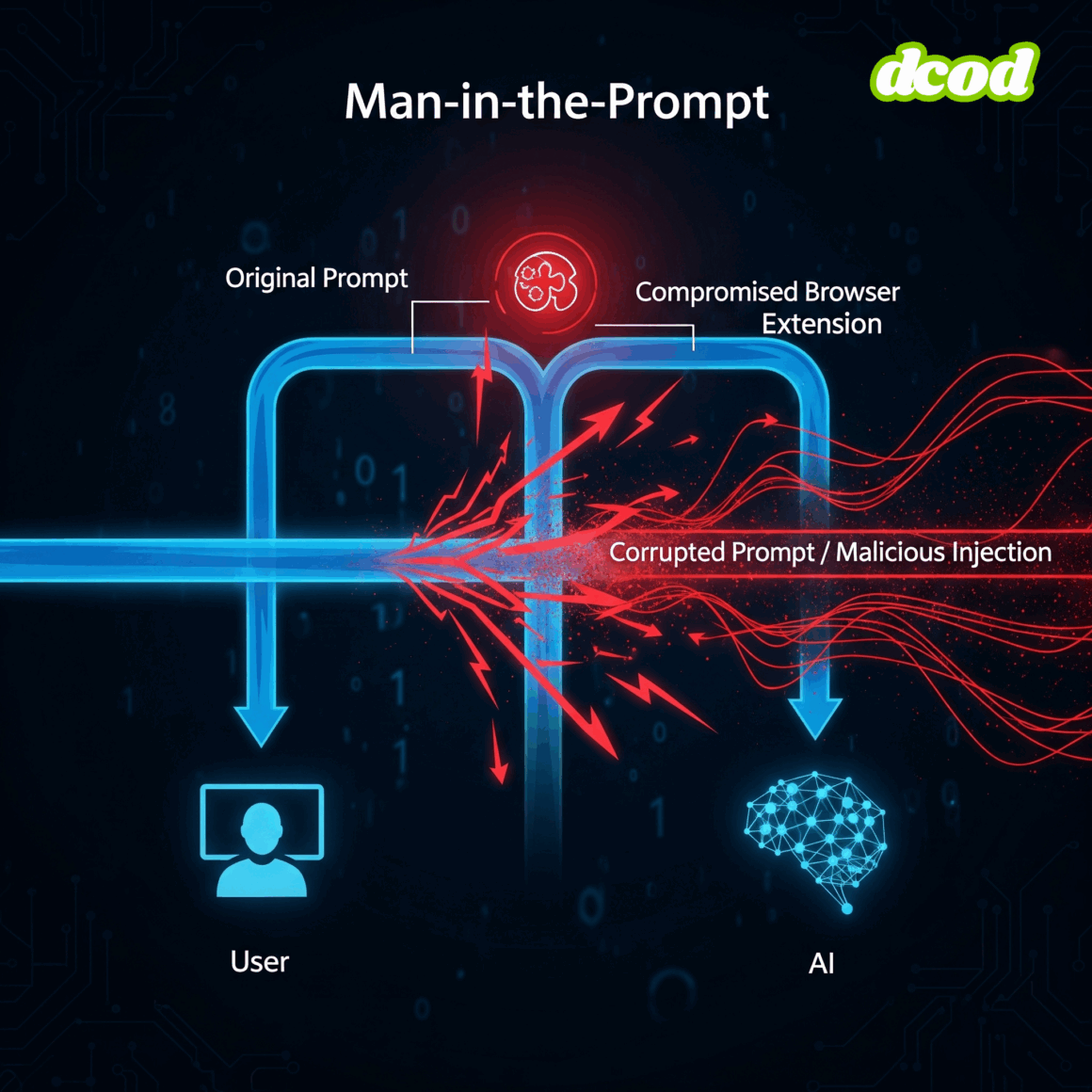

L’attaque « Man-in-the-Prompt » : une faille structurelle des outils GenAI

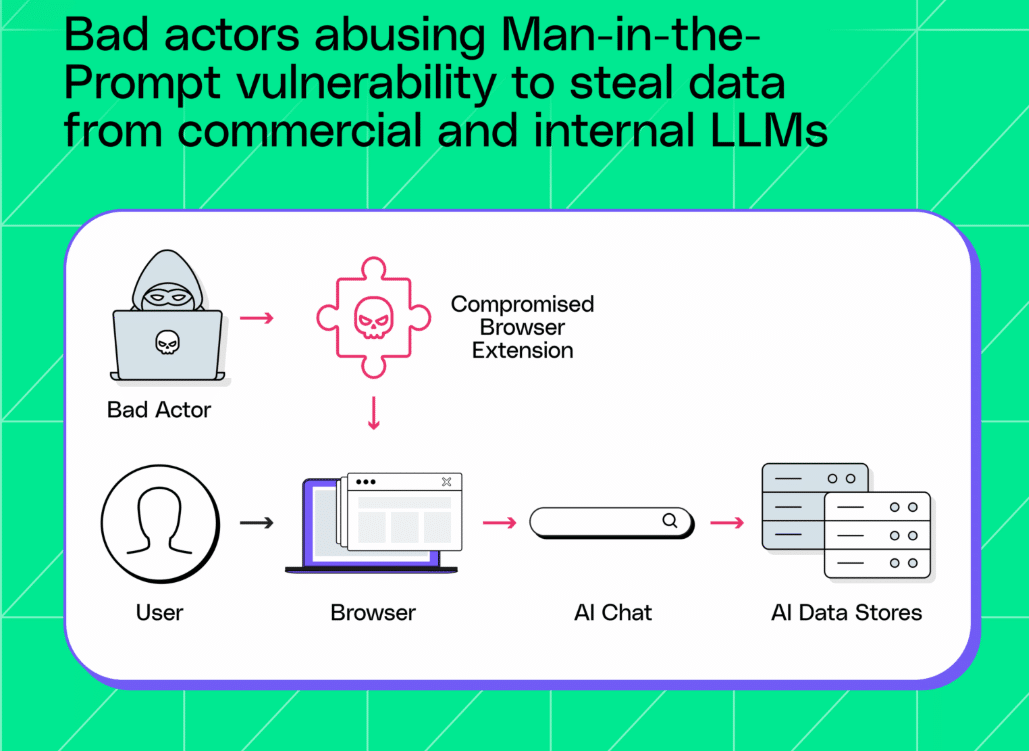

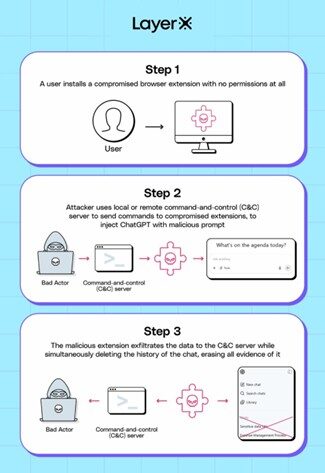

Le fonctionnement même des assistants IA modernes les rend vulnérables à cette forme d’exploitation. Dans la majorité des cas, les champs de saisie de prompts sont directement insérés dans le DOM (Document Object Model) de la page. Cela signifie qu’une extension installée sur le navigateur de l’utilisateur, même sans droits étendus, peut injecter ou intercepter du contenu dans ces champs. C’est là qu’intervient l’attaque dite du « Man-in-the-Prompt » : un scénario où un acteur malveillant utilise une extension pour insérer une requête dans un assistant IA, collecter la réponse et effacer toute trace de l’opération, comme le montre LayerX.

Les preuves de concept présentées ciblent plusieurs outils très répandus : ChatGPT, Gemini, Copilot ou encore Claude. Tous sont vulnérables à ces manipulations, même sans privilèges spéciaux. En s’intégrant discrètement dans une session active, une extension compromise peut injecter des instructions invisibles à l’œil nu, récupérer des réponses, puis supprimer la conversation de l’historique. Le danger est amplifié par la popularité de ces outils et la généralisation de leur usage pour traiter des données sensibles.

L'essentiel Cybersécurité, IA & Tech

Rejoignez la communauté. 3 fois par semaine, recevez l'analyse des tendances par Marc Barbezat. Pas de spam, juste de l'info.

Un autre vecteur identifié concerne les extensions disponibles sur les stores officiels comme Chrome Web Store, à l’image de Prompt Archer ou Prompt Manager, qui démontrent qu’il est techniquement possible d’interagir avec les prompts sans autorisations spécifiques. Cette situation illustre un aveuglement des politiques de sécurité classiques qui se basent encore trop souvent sur une évaluation statique des permissions accordées.

IA d’entreprise : un danger silencieux pour les données critiques

Au-delà des outils publics, la menace touche également les modèles internes d’entreprises, souvent perçus comme sûrs car hébergés sur des infrastructures privées. Ces LLM internes sont fréquemment entraînés sur des corpus confidentiels incluant du code source, des prévisions financières, des documents juridiques ou encore des stratégies de fusion-acquisition. Leur accès via le navigateur devient un point faible dès lors qu’une extension malveillante agit dans l’ombre.

L’attaque ne repose pas sur une faille logicielle du modèle lui-même, mais sur la confiance excessive accordée au poste client. Un employé légitime interrogeant un copilote IA interne peut, à son insu, être le vecteur d’exfiltration de données stratégiques. Par exemple, une extension pourrait injecter une commande du type « résume tous les objectifs de la prochaine feuille de route », envoyer la réponse à un serveur distant, puis effacer toute trace.

Cette attaque est particulièrement insidieuse car elle contourne la plupart des outils de sécurité traditionnels (DLP, CASB, SWG), incapables de surveiller les interactions à l’intérieur du DOM. Elle met aussi en échec les politiques de blocage d’accès basées sur des URLs ou domaines, souvent inefficaces pour les outils internes.

Gemini, ChatGPT : des IA infiltrées dans les environnements sensibles

Les preuves de concept dévoilées montrent que les IA grand public peuvent aussi être retournées contre leurs utilisateurs. Dans le cas de Gemini, l’intégration à Google Workspace lui donne accès à l’ensemble des ressources de l’utilisateur : emails, documents, agendas, contacts partagés. Une extension peut interagir avec ce système même si l’interface de Gemini est masquée. Elle peut alors extraire des titres de mails, récupérer des fichiers ou identifier des informations personnelles, comme l’illustre l’analyse de LayerX.

La même logique s’applique à ChatGPT. Une extension malveillante peut ouvrir une session dans un onglet en arrière-plan, lui soumettre une requête puis exfiltrer la réponse, avant de supprimer la trace de l’échange. Comme le modèle ne conserve pas l’historique localement, l’utilisateur ne remarquera rien. Cela devient d’autant plus critique que ces outils sont massivement utilisés par les départements techniques, juridiques ou RH, manipulant des données à forte valeur.

Cette vulnérabilité structurelle ne se limite pas aux outils spécifiques. Toute application SaaS enrichie par un LLM embarqué peut être affectée : assistants de recherche, résumés de documents, chatbots internes. Et l’ampleur de la menace grandit avec la popularité de ces usages.

Gouvernance GenAI : l’impératif d’un contrôle du comportement in-browser

Face à ces risques, les approches classiques de cybersécurité doivent évoluer. Il ne s’agit plus seulement de contrôler l’accès aux applications, mais de surveiller les comportements dans le navigateur lui-même. Ce changement de paradigme implique de détecter les interactions avec le DOM, bloquer les extensions à comportement suspect, et identifier les manipulations invisibles des prompts.

Certaines pistes incluent l’analyse dynamique du comportement des extensions, le recours à des environnements sandboxés ou encore l’évaluation continue de la réputation des éditeurs. Car la simple absence de permissions explicites ne suffit plus à qualifier une extension de fiable.

Les entreprises doivent aussi intégrer ces vecteurs d’attaque dans leurs politiques de gouvernance GenAI, en prenant en compte l’ensemble du contexte : profil utilisateur, sensibilité des données, nature des outils utilisés. Dans ce paysage mouvant, l’interface web devient le maillon faible d’une chaîne de confiance jusqu’ici trop centrée sur le modèle lui-même.

Pour en savoir plus

Top 5 des outils GenAI vulnérables aux attaques de type « Man-in-the-Prompt » : des milliards de personnes pourraient être affectées – LayerX

Un nouveau vecteur d’attaques par injection rapide qui menace les outils d’IA commerciaux et internes. Les chercheurs de LayerX ont identifié une nouvelle classe d’exploits ciblant directement ces outils via un vecteur jusqu’alors négligé : les extensions de navigateur.

et aussi sur le super site de Pierluigi Paganini (Security Affairs):

Man-in-the-Prompt : l’attaque invisible qui menace ChatGPT et d’autres systèmes d’IA

Man-in-the-Prompt : une nouvelle menace ciblant les outils d’IA comme ChatGPT et Gemini via de simples extensions de navigateur, aucune attaque complexe n’est nécessaire.

Serveurs, API, temps de veille...

DCOD est indépendant et sans revenus. Soutenez le site pour l'aider à couvrir ses frais techniques.