TL;DR : L’essentiel

- Le département de la Défense a mobilisé l’outil Claude via un partenariat avec l’entreprise Palantir lors d’une incursion à Caracas, marquant une première utilisation connue pour une mission classifiée.

- L’intervention armée sur le sol vénézuélien a provoqué la mort de 83 personnes selon le ministère local, soulevant des interrogations sur le respect des politiques d’utilisation interdisant la violence.

- Le contrat liant le Pentagone à la start-up, estimé à environ 200 millions de dollars, fait l’objet de tensions politiques concernant les garde-fous éthiques et les capacités létales de l’IA.

- L’armée américaine diversifie ses ressources technologiques en collaborant également avec les plateformes xAI, Google et OpenAI pour automatiser l’analyse de documents massifs et potentiellement le pilotage de drones autonomes.

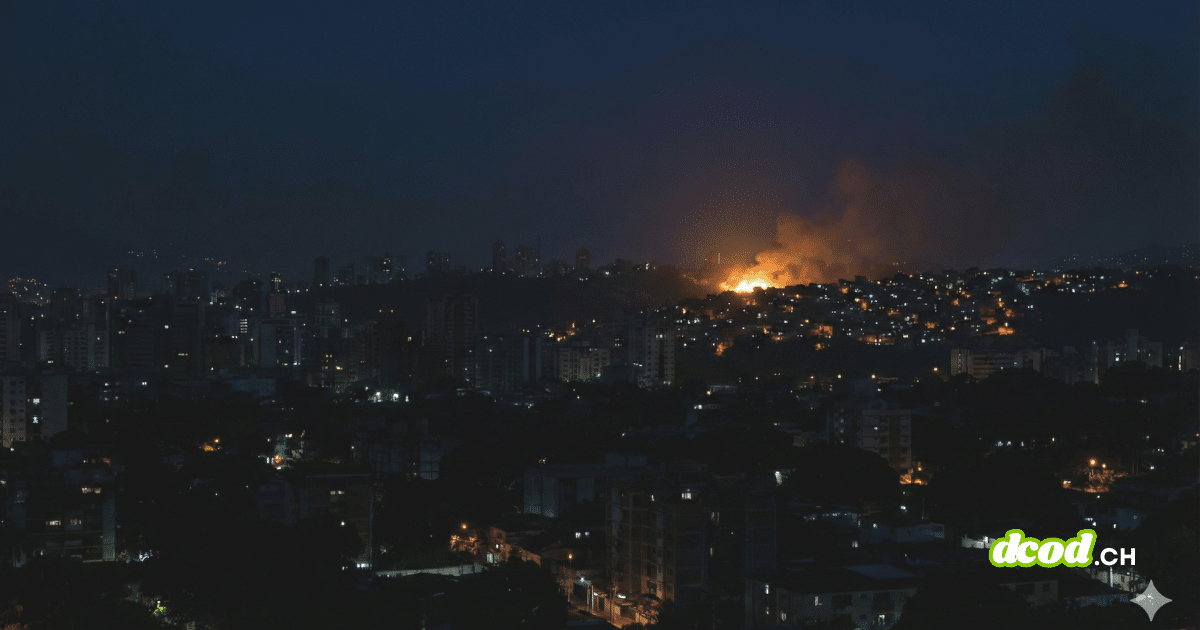

L’incursion militaire menée par les forces armées américaines pour capturer l’ancien président vénézuélien et son épouse marque une nouvelle étape dans l’évolution des conflits modernes. Cette opération ne s’est pas appuyée uniquement sur des moyens conventionnels, comme les bombardements ciblés effectués dans plusieurs zones de la capitale, mais a intégré des outils numériques de nouvelle génération.

L’usage de l’intelligence artificielle au cœur d’une mission classifiée confirme que nous sommes entrés dans l’ère de la guerre hybride. Ce concept désigne des conflits où les armes physiques, tels que les missiles ou les blindés, sont systématiquement complétées par des technologies de l’information pour accélérer la prise de décision et améliorer l’efficacité des frappes sur le terrain.

Le partenariat Palantir et Claude au service du renseignement

Le déploiement de cette technologie s’est concrétisé grâce à une collaboration stratégique entre le créateur du modèle d’intelligence artificielle et une entreprise spécialisée dans l’analyse de données pour la défense. Cette alliance permet de fournir l’infrastructure sécurisée indispensable au fonctionnement de l’IA dans des environnements militaires sensibles, agissant comme un pont technique entre le logiciel civil et les besoins de sécurité nationale. Comme le détaille le Wall Street Journal, cet accord permet au département de la Défense d’exploiter les capacités de traitement massif de l’outil Claude pour des missions de haute importance stratégique.

L'essentiel Cybersécurité, IA & Tech

Rejoignez la communauté. 3 fois par semaine, recevez l'analyse des tendances par Marc Barbezat. Pas de spam, juste de l'info.

Concrètement, ces systèmes sont capables de synthétiser des milliers de pages de rapports en quelques secondes, filtrant le « bruit » informationnel pour ne présenter que les renseignements cruciaux aux commandants. En réduisant la charge cognitive des officiers, l’IA facilite une vision claire de la situation en temps réel. Bien que les détails techniques précis de l’opération restent confidentiels, ces outils peuvent aller jusqu’à identifier des positions stratégiques ou des points de passage qui échapperaient à l’analyse humaine sous pression, tout en offrant la possibilité de piloter des drones de reconnaissance de manière autonome.

Cette assistance numérique transforme radicalement la vitesse de réaction des troupes engagées. Elle permet de convertir des flux de données brutes — qu’il s’agisse d’imagerie satellite complexe ou d’interceptions radios — en ordres de combat quasi instantanés. Cette réactivité devient un avantage critique lors d’extractions en milieu urbain dense comme celui de Caracas, où chaque seconde de décalage entre l’information et l’action peut déterminer l’issue de la mission.

Un dilemme éthique entre régulation et impératifs militaires

L’intégration de ces algorithmes dans des opérations ayant entraîné des pertes humaines soulève des tensions croissantes entre les impératifs de la sécurité nationale et les chartes éthiques des entreprises privées. Ce dilemme oppose directement le besoin de réactivité tactique du Pentagone à la volonté de sécurité absolue prônée par les concepteurs de l’IA.

Le contrat liant l’institution militaire à son fournisseur, dont le montant peut atteindre environ 200 millions de dollars, se heurte désormais aux restrictions contractuelles strictes imposées par la start-up. Ces dernières interdisent théoriquement tout usage de leur technologie visant à faciliter la violence directe, à participer au développement d’armements sophistiqués ou à mener des activités de surveillance de masse.

Selon les informations rapportées par The Guardian, cette position prudente et les appels répétés du dirigeant de l’entreprise en faveur d’une régulation gouvernementale stricte irritent profondément certains hauts responsables militaires. Le secrétaire à la Défense a d’ailleurs rappelé avec fermeté, lors d’une allocution en début d’année, que l’agence ne comptait pas s’appuyer durablement sur des modèles dont les limitations éthiques empêcheraient, par nature, les forces armées de mener efficacement des actions de guerre.

L’automatisation du champ de bataille devient la norme

L’adoption de ces technologies ne se limite pas à un seul prestataire mais s’étend à l’ensemble des géants de la Silicon Valley. Outre l’accord récent avec la structure xAI appartenant au propriétaire de la plateforme de réseaux sociaux, le Pentagone utilise déjà des versions adaptées des outils développés par Google et OpenAI. Ces plateformes assistent actuellement environ 3 millions de personnels militaires dans des tâches de recherche et de rédaction de rapports de situation. Cependant, la transition vers des fonctions plus tactiques, comme la création de listes de cibles automatiques ou la gestion autonome d’appareil de vol, indique un changement de paradigme. L’intelligence artificielle n’est plus un simple soutien de bureau, mais un véritable rouage du commandement opérationnel. Cette porosité croissante entre outils civils et militaires redéfinit les règles d’engagement et impose une surveillance accrue sur la responsabilité des algorithmes dans les décès liés aux combats.

L’opération au Venezuela prouve que l’intelligence artificielle est désormais un pilier de la souveraineté militaire. Alors que les entreprises technologiques luttent pour justifier leur importance auprès des investisseurs, leur intégration massive dans l’arsenal du département de la Défense leur offre un rôle central, tout en posant des défis moraux sans précédent sur l’automatisation de la force létale.

Pour approfondir le sujet

Anthropic refuse les nouvelles conditions du Pentagone et maintient sa position sur les armes autonomes létales et la surveillance de masse.

Anthropic a refusé les nouvelles conditions du Pentagone et les pressions de Pete Hegseth, restant ferme sur sa position concernant les armes autonomes létales et la surveillance de masse utilisant l'IA. Lire la suite

À l'intérieur des négociations existentielles d'Anthropic avec le Pentagone

Un ancien cadre d'Uber joue la carte de la fermeté, mais pour le laboratoire d'IA, l'enjeu dépasse largement le simple contrat militaire de 200 millions de dollars. Lire la suite

Le Pentagone envisage de désigner l'IA anthropique comme un « risque pour la chaîne d'approvisionnement » : rapport

Cette mesure obligerait toute personne faisant affaire avec l'armée américaine à rompre tout lien avec cette entreprise spécialisée en intelligence artificielle. Lire la suite

Cyberattaque au Venezuela : L’action US plonge Caracas dans le noir

Une cyberattaque américaine inédite aurait coupé l'électricité lors de la capture du dirigeant vénézuélien. Analyse tactique d'un black-out ciblé et ses effets. Lire la suite

Zéro paywall. Zéro pub.

DCOD reste en accès libre grâce à vos contributions. Chaque café compte.