La reconnaissance faciale en direct atteint 962 arrestations à Londres, mais la question de l’équité technique et sociale continue d’alimenter le débat public.

En bref

- Les déploiements de reconnaissance faciale ont permis d’interpeller 962 personnes en un an, principalement dans des zones identifiées comme criminogènes.

- Le rapport officiel détaille plus de trois millions de visages scannés pour seulement dix fausses alertes, soit un taux d’erreur minimal.

- Les analyses montrent une surreprésentation de certaines catégories démographiques dans les alertes, un sujet particulièrement sensible médiatiquement.

- Les déploiements ont également permis de localiser de nombreux individus soumis à des ordonnances judiciaires, renforçant la capacité de suivi des autorités.

Le dernier rapport annuel sur la reconnaissance faciale en direct décrit une année marquée par une intensification des déploiements dans les rues de Londres. Les opérations se sont concentrées sur des zones de criminalité élevée, tout en s’étendant à des événements sensibles où la sécurité publique constitue une priorité. L’ensemble des données reflète une technologie désormais structurante pour les services de police, autant pour l’arrestation de suspects que pour le repérage de profils soumis à des obligations judiciaires. Cependant, les résultats particulièrement élevés s’inscrivent dans un débat public plus large, où la performance technique ne dissipe pas totalement les interrogations liées à la proportionnalité, à la transparence et à la présence éventuelle de biais.

Efficacité opérationnelle et montée en puissance des déploiements

Le rapport détaillé publié sur le site institutionnel met.police.uk présente 203 déploiements dans les quartiers identifiés comme les plus sensibles et couvre la période de septembre 2024 à septembre 2025. Plus de trois millions de visages ont été scannés pour un total de 2 077 alertes, dont seulement dix se sont révélées fausses. Les résultats opérationnels atteignent 962 arrestations, majoritairement des personnes faisant l’objet de mandats judiciaires ou recherchées pour infractions graves. Une partie significative des interpellations concerne des faits de violence, notamment des agressions ciblant des femmes ou des actes commis au sein du cercle familial.

Les opérations reposent sur une organisation structurée, avec des véhicules spécialisés circulant régulièrement dans les zones concernées. Chaque intervention est soumise à une procédure d’autorisation qui analyse l’impact sur les droits individuels, les conditions locales de sécurité et le niveau de risque. Les données montrent également que la reconnaissance faciale permet de résoudre des affaires anciennes, notamment lorsque les méthodes d’enquête classiques n’ont pas permis d’identifier ou de localiser les suspects.

L'essentiel Cybersécurité, IA & Tech

Rejoignez la communauté. 3 fois par semaine, recevez l'analyse des tendances par Marc Barbezat. Pas de spam, juste de l'info.

Cette technologie joue un rôle important dans la supervision des personnes soumises à des obligations judiciaires. Plus d’un millier d’interactions ont été recensées, permettant de détecter des manquements, parfois graves, aux conditions fixées par les tribunaux. La reconnaissance faciale contribue également à renforcer la sécurité lors d’événements à forte affluence. Autour du Notting Hill Carnival, les déploiements ont permis de localiser des personnes recherchées avant leur entrée dans la zone, limitant ainsi les risques de violences.

Biais potentiels, représentations démographiques et défis d’équité

Les questions liées aux biais et à la proportionnalité demeurent centrales dans l’analyse de cette technologie. L’article publié par The Register souligne que la reconnaissance faciale fait l’objet d’un examen constant quant à son impact sur différentes catégories de population. Le rapport officiel fournit une analyse précise des dix fausses alertes enregistrées. Bien que ce chiffre soit extrêmement faible, huit des personnes concernées étaient perçues comme noires, suscitant des interrogations quant à la distribution des erreurs.

Les auteurs du document rappellent toutefois que l’échantillon est trop restreint pour en tirer des conclusions statistiques. Ils soulignent que les déploiements se concentrent dans des zones où la criminalité est plus élevée, avec des compositions démographiques différentes de celles de la ville dans son ensemble. Cette réalité crée un cadre d’analyse complexe, dans lequel les alertes reflètent autant les dynamiques sociales locales que les performances de l’algorithme.

Les fausses alertes analysées présentent des causes variées : qualité insuffisante des images enregistrées en garde à vue, éclairage inadéquat, mouvements rapides, angles défavorables ou obstructions partielles du visage. Dans certains cas, la technologie se trouve confrontée à des situations limites, comme l’identification de jumeaux identiques. Pour réduire ces risques, des actions sont prévues : amélioration des équipements photographiques, uniformisation des fonds utilisés lors des prises de vue, nouveaux outils d’assistance pour les officiers et contrôles renforcés.

Les listes de surveillance reflètent un autre aspect de la question. Elles regroupent principalement des individus recherchés par les tribunaux, suivis par des personnes sous supervision judiciaire ou des suspects d’infractions graves. Cette composition ne reflète pas la population générale, mais les réalités opérationnelles et judiciaires. La reconnaissance facial tend donc à reproduire la structure des priorités policières, ce qui complique l’analyse purement algorithmique des biais.

Entre confiance publique et impératif de transparence

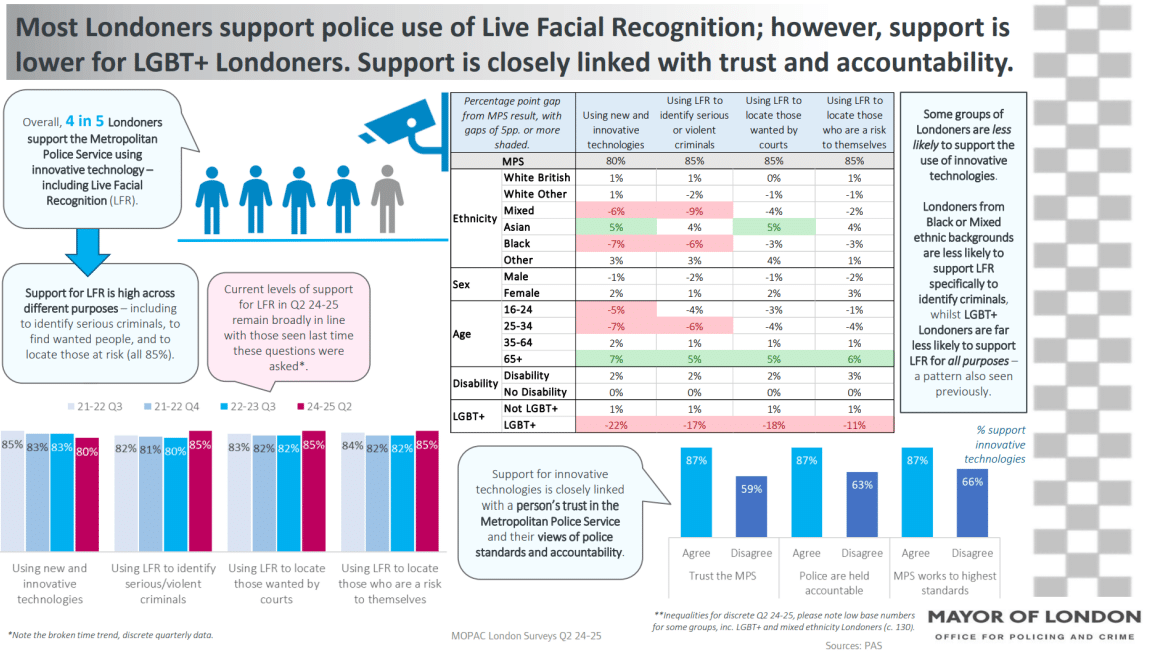

La dimension sociale constitue une part importante du rapport. Les enquêtes menées montrent un soutien majoritaire au déploiement de la reconnaissance faciale, avec un niveau d’acceptation relativement régulier dans l’ensemble des quartiers. Néanmoins, la confiance dans les institutions varie selon les communautés, une réalité qui influence fortement la manière dont cette technologie est perçue.

Les opérations de reconnaissance faciale s’accompagnent d’un dispositif d’information et de dialogue : signalétique sur place, annonces préalables, rencontres avec les responsables locaux, ou encore échanges avec des lieux de culte pour s’assurer que les déploiements ne perturbent pas des moments sensibles. Cette approche vise à anticiper les tensions et à instaurer un cadre d’utilisation acceptable dans des contextes sociaux parfois fragiles.

Le rapport souligne que cette communication est essentielle pour renforcer la légitimité de la technologie. Elle permet de contextualiser son usage, d’expliquer les raisons de sa présence dans certaines zones et de clarifier la manière dont les données sont traitées. Toutefois, même avec ces efforts, la relation entre confiance publique et technologies de surveillance reste délicate, notamment dans les quartiers où les interactions passées avec les autorités peuvent peser sur la perception actuelle.

L’ensemble des éléments publiés montre que la reconnaissance faciale à Londres se situe aujourd’hui à un carrefour stratégique. D’un côté, les résultats opérationnels démontrent une capacité à renforcer la sécurité publique dans des zones confrontées à une criminalité persistante. De l’autre, les attentes en matière d’équité, de transparence et de proportionnalité obligent les autorités à une vigilance constante. Les prochaines années dépendront autant des capacités techniques que de la manière dont les institutions sauront préserver la confiance des communautés les plus exposées.

Cette veille vous a été utile ?

Un café = un mois de serveur. Aidez DCOD à rester gratuit et indépendant.