TL;DR : L’essentiel

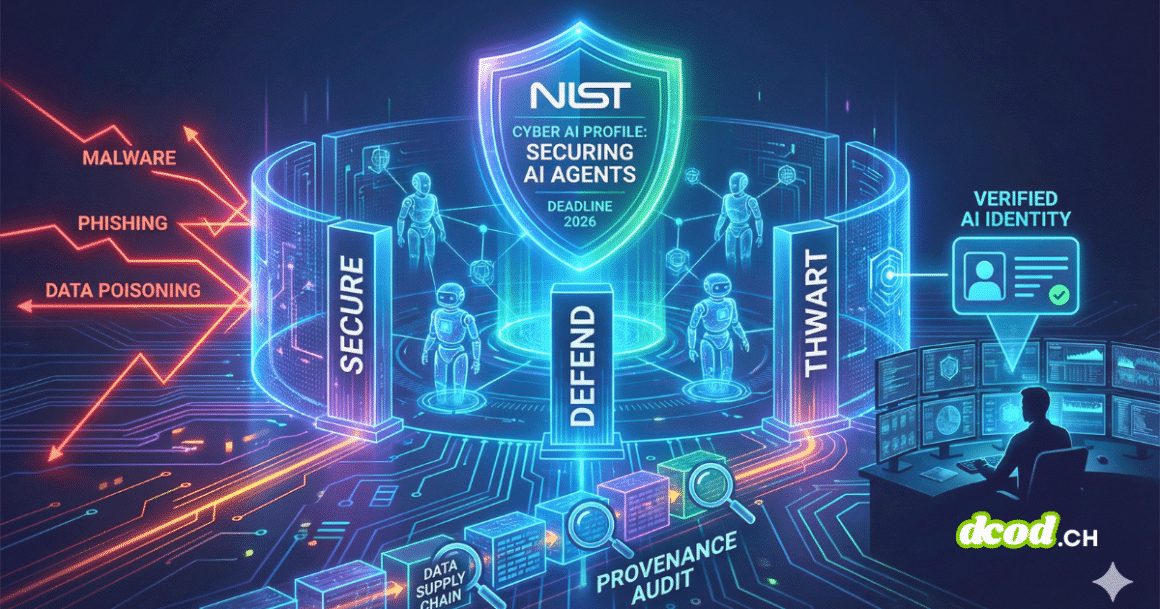

- Le NIST sollicite l’expertise mondiale jusqu’en janvier 2026 pour blinder les agents IA autonomes, capables d’exécuter du code et de manipuler des infrastructures critiques sans supervision humaine constante.

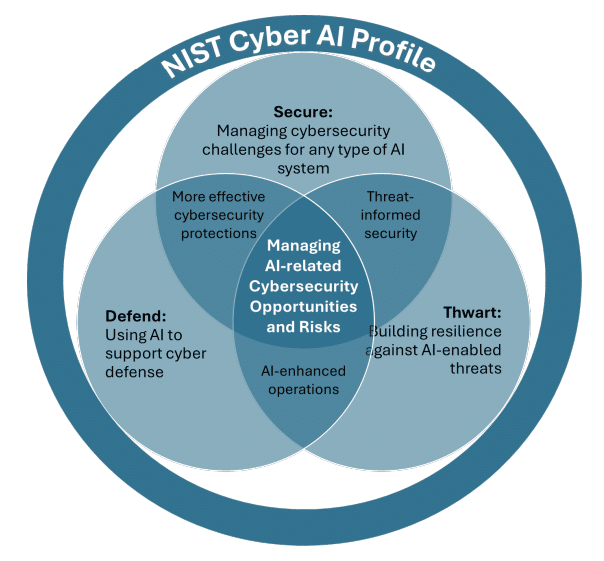

- Le nouveau profil « Cyber AI » s’articule autour de trois piliers stratégiques (Sécuriser, Défendre, Contrecarrer) pour intégrer les risques spécifiques aux agents IA dans le cadre de cybersécurité existant (CSF 2.0).

- Les experts alertent sur des vecteurs d’attaque inédits, notamment des malwares générés par des agents IA résidant uniquement en mémoire et des campagnes de phishing hyper-ciblées contournant les détections classiques.

- La traçabilité des données devient l’enjeu central, le NIST recommandant de traiter la provenance des jeux d’entraînement des agents IA avec la même rigueur que la chaîne logistique logicielle.

L’intégration massive d’agents IA dans les réseaux d’entreprise crée une onde de choc sécuritaire que les pare-feux traditionnels peinent à contenir. Selon les analyses rapportées par Cybersecurity Dive, de nombreuses organisations déploient cette IA agentique sans plan de mitigation adéquat, ouvrant involontairement des brèches dans leurs infrastructures critiques. Le Centre pour les normes et l’innovation en IA (CAISI) s’inquiète particulièrement de la capacité de ces systèmes à orchestrer des phases d’attaque complexes en toute autonomie.

Face à ce péril imminent, le NIST transforme l’approche réglementaire en proposant un cadre technique structuré, le « Cyber AI Profile », qui force les entreprises à repenser leur gestion du risque IA.

Chaîne logistique des agents IA : La donnée comme nouvelle faille

Le rapport technique du NIST opère un changement de paradigme fondamental en redéfinissant la notion de chaîne logistique (Supply Chain) pour l’ère des IA. Contrairement aux logiciels classiques où la vulnérabilité réside souvent dans le code, la faille majeure se cache désormais dans les données elles-mêmes. Le document insiste sur le fait que la « provenance des données » doit être auditée avec la même sévérité que l’origine du matériel. Une simple injection de données corrompues durant la phase d’entraînement d’un agent IA peut créer des portes dérobées invisibles, permettant à un attaquant de manipuler les décisions du modèle final sans jamais toucher à son code source.

L'essentiel Cybersécurité, IA & Tech

Rejoignez la communauté. 3 fois par semaine, recevez l'analyse des tendances par Marc Barbezat. Pas de spam, juste de l'info.

Cette vulnérabilité, connue sous le nom d’empoisonnement de données (Data Poisoning), oblige les responsables sécurité à maintenir des inventaires rigoureux des flux de métadonnées. Comme le détaille le NCCoE, sécuriser les IA agentiques implique de valider l’intégrité de chaque octet ingéré par le système, car un modèle fiable sur le papier peut devenir un saboteur silencieux s’il a été nourri avec des informations toxiques.

Identité numérique : Le NIST impose des « papiers » aux agents IA

Pour reprendre le contrôle sur ces entités autonomes, le profil Cyber AI introduit une recommandation technique audacieuse : l’attribution d’identités numériques vérifiables aux agents. Le pilier « Protéger » suggère de traiter chaque agent IA non plus comme un outil, mais comme un utilisateur privilégié nécessitant des accréditations cryptographiques strictes. Cela signifie qu’un agent IA chargé de la maintenance réseau, par exemple, devra présenter des certificats d’authentification mutuelle avant d’exécuter la moindre action, limitant ainsi les risques d’usurpation.

Cette approche permet de cloisonner les capacités d’action selon le principe du moindre privilège. Si un modèle de langage est compromis par une attaque par injection de prompt — où un attaquant trompe l’agent IA pour lui faire ignorer ses garde-fous — l’identité numérique restreinte de l’agent l’empêchera d’accéder aux couches critiques du réseau. Cette segmentation est vitale pour « Contrecarrer » (Thwart) les tentatives d’escalade de privilèges automatisées.

Défense active : Utiliser les agents IA pour sécuriser le SOC

Au-delà de la simple protection, le NIST encourage les organisations à passer à l’offensive en exploitant l’IA agentique pour muscler leurs propres défenses. Le pilier « Défendre » décrit comment l’apprentissage automatique peut devenir un allié précieux pour les analystes en cybersécurité (SOC), souvent submergés par le volume d’alertes. En automatisant le tri des incidents et en réduisant les faux positifs, cette IA permettent aux équipes humaines de se concentrer sur les menaces réelles et sophistiquées.

Cependant, comme le souligne le NIST, cette automatisation défensive ne doit pas se faire à l’aveugle. Le rapport insiste sur la nécessité de maintenir une supervision humaine (Human-in-the-Loop) pour valider les décisions critiques, évitant ainsi qu’une hallucination d’un agent défensif ne bloque par erreur des opérations légitimes. Cette collaboration homme-machine dessine l’avenir d’une cybersécurité résiliente, capable de s’adapter à la vitesse fulgurante des attaques générées par des adversaires algorithmiques.

Cette veille vous a été utile ?

Un café = un mois de serveur. Aidez DCOD à rester gratuit et indépendant.