TL;DR : L’essentiel

- Cette décision fait suite à une augmentation massive des signalements liés à l’IA, poussant la communauté à adopter des règles plus strictes pour préserver l’intégrité du savoir.

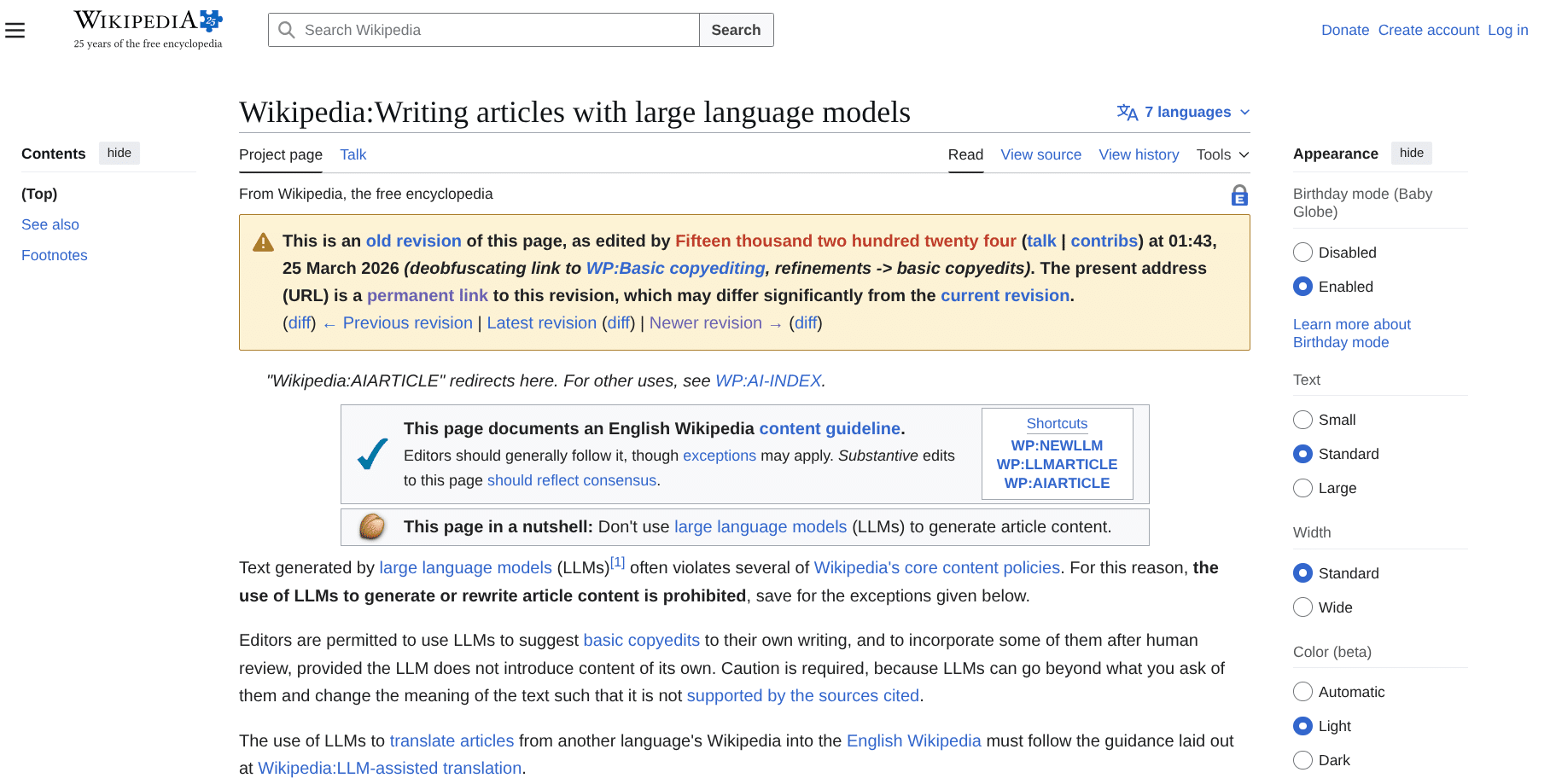

- Le règlement souligne que les textes automatisés violent souvent les politiques de contenu fondamentales, notamment en inventant des faits non vérifiables ou en dénaturant le sens des sources citées.

- Deux exceptions notables sont maintenues : les contributeurs peuvent utiliser l’intelligence artificielle pour des corrections de forme mineures ou pour assister la traduction d’articles entre différentes versions linguistiques.

- Les éditeurs ont voté à une majorité de 40 contre 2 pour interdire l’usage des modèles de langage dans la création de contenus, craignant une saturation des révisions humaines.

Wikipédia a franchi une étape en interdisant officiellement l’usage des grands modèles de langage pour la création et la révision substantielle de ses contenus. Cette décision, adoptée par la communauté des contributeurs bénévoles, vise à préserver la fiabilité d’une base de données qui compte plus de 7,1 millions d’articles dans sa version anglophone. Alors que les synthèses générées par des outils comme ChatGPT ou Google Gemini gagnent en popularité, l’encyclopédie privilégie la rigueur humaine pour éviter la prolifération de textes dont les affirmations ne reposent sur aucune source vérifiable.

Grands modèles de langage : Un risque pour la fiabilité factuelle

Le texte produit par les systèmes d’intelligence artificielle contrevient régulièrement aux politiques de contenu fondamentales qui régissent la plateforme collaborative. Comme l’indique Wikipedia, ces algorithmes peuvent outrepasser les consignes initiales et modifier le sens profond d’un paragraphe, rendant les informations incompatibles avec les références citées. Cette dérive technique force les éditeurs à une vigilance constante pour supprimer les passages qui ne correspondent pas à la réalité historique ou scientifique.

La lutte contre ces contenus automatisés est désormais coordonnée par le groupe WikiProject AI Cleanup, dont la mission consiste à repérer et éliminer les erreurs factuelles introduites par les machines. Les membres de ce projet notent que l’utilisation de l’intelligence artificielle pour s’informer s’est généralisée, au point que certains services de discussion ont dépassé l’audience de l’encyclopédie l’année dernière.

L'essentiel Cybersécurité, IA & Tech

Rejoignez la communauté. 3 fois par semaine, recevez l'analyse des tendances par Marc Barbezat. Pas de spam, juste de l'info.

Rédaction assistée : Les limites de l’automatisation encadrée

Malgré une interdiction globale, le nouveau règlement prévoit des dérogations spécifiques pour ne pas entraver totalement l’innovation technologique au sein de l’espace numérique. Selon The Guardian, les contributeurs conservent le droit d’utiliser des modèles de langage pour suggérer des corrections de forme sur leurs propres écrits. Ces ajustements mineurs ne doivent cependant jamais introduire d’éléments factuels inédits et restent soumis à une validation humaine systématique avant toute publication définitive sur le site.

Le second volet des exceptions concerne la traduction d’articles d’une langue vers une autre, une tâche particulièrement complexe pour les bénévoles de la plateforme. L’usage de l’intelligence artificielle reste autorisé dans ce cadre précis, à condition de suivre des directives strictes pour éviter l’importation de contresens ou de termes inappropriés qui pourraient dégrader la qualité encyclopédique. Les responsables du projet soulignent que si ces outils peuvent aider à structurer la pensée ou à corriger la syntaxe, ils ne possèdent pas encore la maturité nécessaire pour assurer seuls la rédaction.

Communauté Wikipédia : Un vote contre la saturation numérique

Le passage à cette politique restrictive résulte d’un débat intense entre les éditeurs, marqué par une transition de l’optimisme vers une inquiétude concrète face au volume croissant des modifications automatiques. D’après le média spécialisé 404 Media, le vote s’est soldé par une majorité de 40 voix favorables contre seulement 2 oppositions, témoignant d’un consensus fort. Cette mesure vise à protéger les réviseurs humains qui se sentaient submergés par des propositions de changements générées à une vitesse impossible à suivre manuellement.

Le fondateur de la plateforme a lui-même décrit la situation actuelle comme un désordre complexe, estimant que les technologies actuelles ne sont pas encore assez performantes pour les standards de qualité requis. La Wikimedia Foundation indique continuer d’observer ces évolutions avec prudence, privilégiant la protection de l’écosystème informationnel face aux risques de dégradation de la vérité numérique.

En limitant drastiquement le rôle des modèles de langage, Wikipédia souhaite donc réaffirmer la supériorité du cerveau humain sur les processus de synthèse automatique 😉

Pour approfondir le sujet

Wikipédia : Rédiger des articles avec de grands modèles de langage – Wikipédia

Les textes générés par les grands modèles de langage (GML)[1] enfreignent souvent plusieurs règles fondamentales de Wikipédia relatives au contenu. C’est pourquoi l’utilisation des GML pour générer ou réécrire le contenu des articles est interdite, sauf exceptions mentionnées ci-dessous. Lire la suite

Actualités liées

Un agent IA a été interdit de créer des articles Wikipédia, puis a écrit des billets de blog rageurs pour exprimer sa colère face à cette interdiction.

Cet incident est un nouvel exemple de la lutte des contributeurs bénévoles de Wikipédia pour préserver le plus grand dépôt mondial de connaissances humaines des inepties générées par l'IA. Lire la suite

Zéro paywall. Zéro pub.

DCOD reste en accès libre grâce à vos contributions. Chaque café compte.