Voici le tour d’horizon hebdomadaire des actualités à l’intersection de l’intelligence artificielle et de la cybersécurité : avancées technologiques, vulnérabilités, usages malveillants, réglementations et initiatives stratégiques à suivre.

Faits marquants de la semaine

- OpenAI envisagerait d’intégrer dans ChatGPT un format publicitaire de « contenu sponsorisé » directement dans les réponses, avec un impact potentiel sur les décisions d’achat des utilisateurs et la hiérarchisation des recommandations affichées.

- L’éditeur de ChatGPT estime que les failles de type « prompt injection » ne pourront probablement jamais être totalement éliminées, reconnaissant une limite structurelle à la sécurisation des interactions entre modèles d’IA et contenus web.

- Un cofondateur de Mistral AI est accusé d’avoir orchestré chez Meta le téléchargement de millions de livres piratés, une enquête basée sur des documents judiciaires soulevant des doutes sur l’origine des modèles du champion français de l’IA.

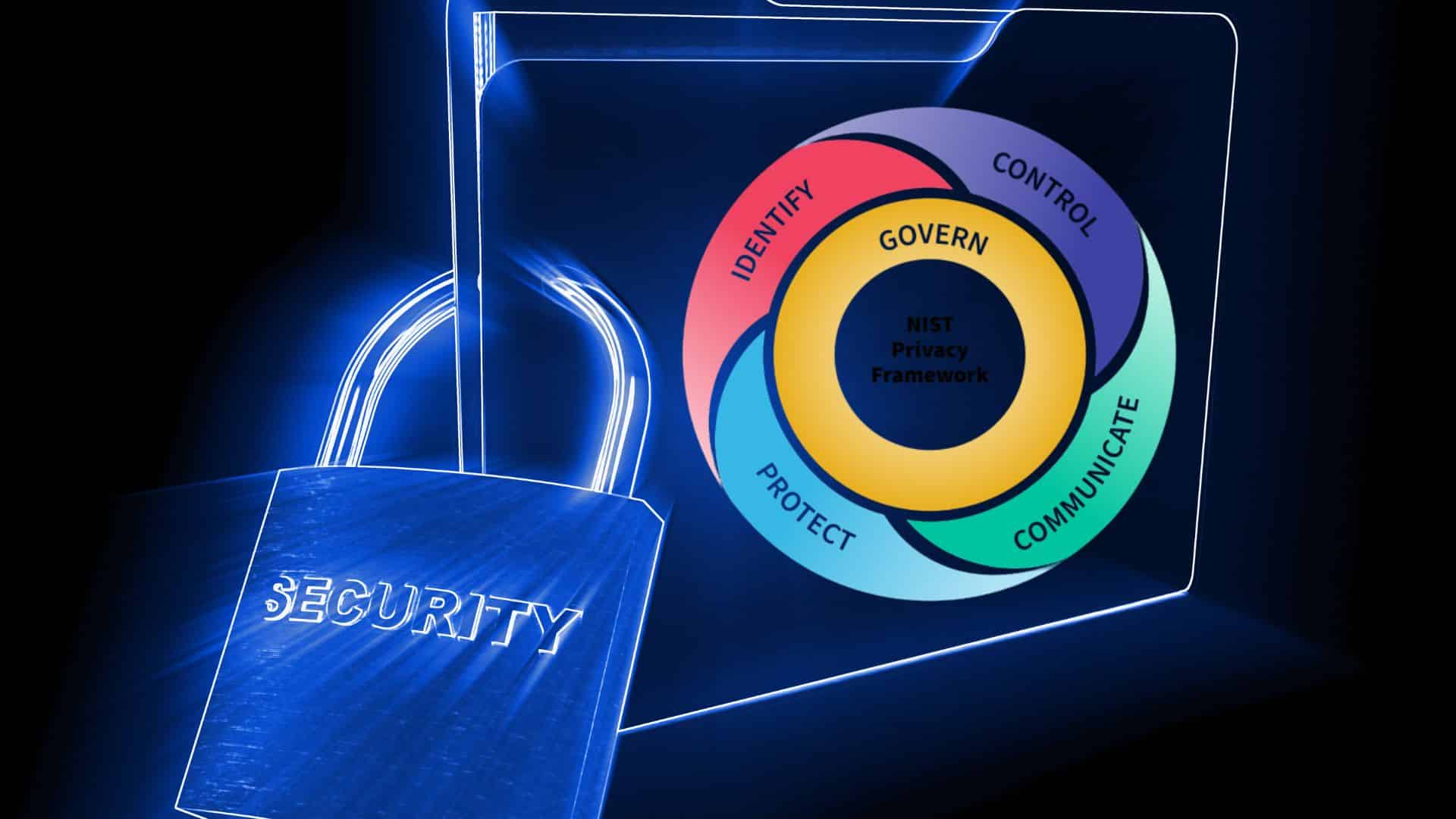

- L’État de New York adopte la loi RAISE pour imposer aux entreprises d’IA davantage de transparence sur la sécurité de leurs modèles, y compris la publication de leurs protocoles et l’obligation de signalement, en dépit d’un décret présidentiel opposé.

La monétisation de ChatGPT via du contenu sponsorisé et la reconnaissance par son éditeur que les attaques par « prompt injection » resteront probablement insolubles mettent en lumière les tensions entre développement commercial et limites de sécurité des agents d’IA. Sur le front éthique et juridique, les accusations de piratage massif de livres chez Meta impliquant un dirigeant de Mistral AI interrogent la licéité des jeux de données utilisés pour entraîner certains modèles. En parallèle, la régulation se structure, avec la loi RAISE à New York, tandis que les États-Unis financent via NIST et MITRE de nouveaux centres de recherche sur l’impact de l’IA sur les infrastructures critiques, dans un contexte où des failles graves découvertes dans le chatbot d’Eurostar entraînent un bras de fer avec les chercheurs.

L'essentiel Cybersécurité, IA & Tech

Rejoignez la communauté. 3 fois par semaine, recevez l'analyse des tendances par Marc Barbezat. Pas de spam, juste de l'info.

La sélection des 6 actualités à retenir cette semaine

Les publicités ChatGPT d'OpenAI privilégieraient, semble-t-il, le contenu sponsorisé dans les réponses.

OpenAI envisagerait d'introduire une nouvelle forme de publicité sur ChatGPT, appelée « contenu sponsorisé », susceptible d'influencer vos décisions d'achat. […] Lire la suite

Les perspectives d'OpenAI concernant la sécurité des navigateurs IA sont sombres, mais peut-être qu'un peu plus d'IA pourrait y remédier.

L'entreprise à l'origine de ChatGPT affirme que les vulnérabilités liées à l'injection rapide ne seront probablement jamais totalement « résolues ». Lire la suite

Mistral AI : son cofondateur au cœur d'un scandale de piratage massif chez Meta

Guillaume Lample, cofondateur de Mistral AI, est accusé d'avoir piloté le téléchargement de millions de livres piratés lorsqu'il était chez Meta. Une enquête de Mediapart, basée sur des documents judiciaires, expose des pratiques qui éclaboussent le fleuron… Lire la suite

New York promulgue une loi sur la sécurité de l'IA, ignorant le décret présidentiel de Trump qui vise à empêcher les États de réglementer la technologie au nom de la compétition avec la Chine

New York promulgue une loi sur la sécurité de l'IA, ignorant le décret présidentiel de Trump qui vise à empêcher les États de réglementer la technologie au nom de la compétition avec la ChineLa gouverneure de New… Lire la suite

Le NIST et le MITRE annoncent un investissement de 20 millions de dollars dans la recherche sur la cybersécurité de l'IA.

L'Institut national des normes et de la technologie (NIST) a annoncé un partenariat avec la MITRE Corporation pour un projet de 20 millions de dollars visant à créer deux nouveaux centres de recherche sur l'intelligence artificielle, notamment… Lire la suite

Eurostar accuse des chercheurs de chantage pour avoir signalé des failles dans son chatbot IA.

Des chercheurs ont découvert des failles critiques dans le chatbot IA d'Eurostar, notamment l'injection de messages, l'injection HTML, le contournement des garde-fous et des identifiants de chat non vérifiés ; Eurostar les a par la suite accusés de… Lire la suite

Cette veille vous a fait gagner du temps ?

Aidez DCOD à payer ses serveurs et à rester 100% gratuit et indépendant.