TL;DR : L’essentiel

- L’assistant IA Moltbot, renommé précipitamment suite à une plainte d’Anthropic, a déclenché une vague de faux jetons cryptos et d’arnaques, incluant une image virale grotesque d’un homard à visage humain prise au sérieux par les internautes.

- Le projet a connu une croissance fulgurante de près de 155% par jour, accumulant plus de 113 000 étoiles sur GitHub, tandis que des attaquants scannent déjà les ports par défaut pour contourner l’authentification.

- Un chercheur a démontré la vulnérabilité du système en injectant un fichier SVG malveillant qui diffuse la musique de Matrix pendant que des homards dansent autour d’une photo retouchée, prouvant la prise de contrôle totale.

- Selon Token Security, plus de 20% des employés de leurs clients utilisent déjà cet outil au bureau, exposant les entreprises au « Lethal Trifecta » : accès aux données sensibles, contenu non fiable et communication externe.

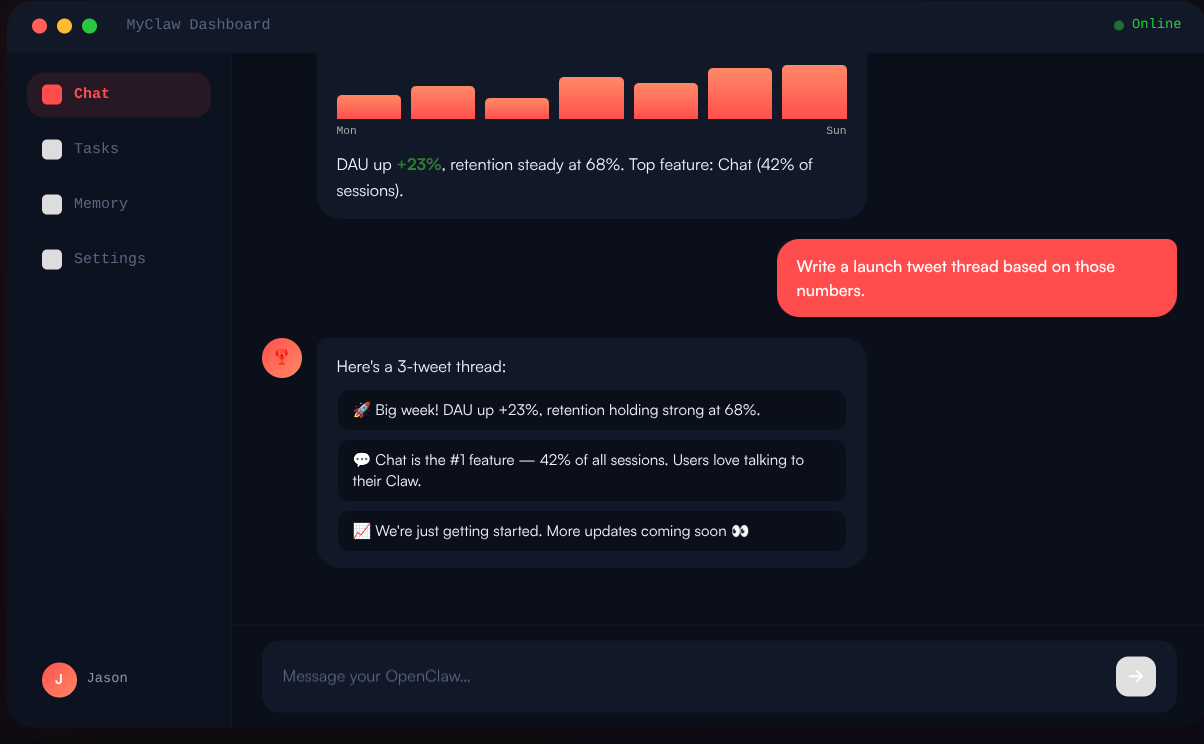

OpenClaw et Moltbot provoque un engouement pour les agents IA autonomes et viennent de franchir un seuil critique, mêlant fascination technologique et chaos sécuritaire digne du Far West numérique. Ce qui a commencé comme un modeste projet parallèle nommé Clawdbot a muté à une vitesse vertigineuse. Rebaptisé Moltbot sous la pression juridique d’Anthropic, puis finalement OpenClaw, le logiciel s’est transformé en un phénomène incontrôlable, où chaque changement d’identité a alimenté la confusion et l’opportunisme des cybercriminels. Propulsé par une communauté fervente pratiquant le « vibe coding » — une méthode de développement intuitive où des amateurs assemblent des systèmes complexes sans architecte logiciel ni audit de sécurité — OpenClaw promet une révolution de la productivité personnelle. Il ne se contente pas de discuter : il revendique la gestion intégrale de votre vie numérique, accédant sans filtre à vos applications locales, de votre calendrier à vos emails confidentiels. Cependant, cette permissivité technique, si elle a suffi à faire bondir l’action de Cloudflare de près de 15% face à l’afflux de trafic généré par Moltbot, s’accompagne de vulnérabilités systémiques majeures.

Meta acquiert Moltbook, un réseau social d'agents IA.

Les cofondateurs de Moltbook, une plateforme pour agents d'intelligence artificielle, rejoindront l'unité de recherche en IA du géant technologique. Lire la suite

OpenClaw (ex-Moltbot) : Une infrastructure qui opacifie la traque

L’aspect le plus alarmant de l’architecture héritée de Moltbot réside dans sa perméabilité structurelle aux attaques externes. Comme le rapporte 404 Media, un hacker a prouvé qu’il était très simple de compromettre la machine d’un utilisateur en exploitant n’importe quel processus exposé au web, permettant par rebond un accès latéral à des données critiques comme l’historique des messages Signal. La démonstration la plus spectaculaire d’une attaque par la chaîne d’approvisionnement a consisté à héberger un fichier graphique vectoriel (SVG) piégé sur les serveurs du magasin d’applications de l’outil, ClawdHub. L’injection de JavaScript via ce simple fichier a permis une prise de contrôle totale de la session OpenClaw.

L'essentiel Cybersécurité, IA & Tech

Rejoignez la communauté. 3 fois par semaine, recevez l'analyse des tendances par Marc Barbezat. Pas de spam, juste de l'info.

Au-delà de cette démonstration, les risques d’infiltration sont insidieux. Une « compétence » (skill) baptisée « What Would Elon Do », censée imiter le célèbre milliardaire, contenait en réalité un script déclenchant une fenêtre de commande avec le message « YOU JUST GOT PWNED ». Pour tromper la vigilance des utilisateurs, le script a artificiellement gonflé son compteur de téléchargements de 4000 unités, exploitant la confiance aveugle que la communauté place dans les métriques de popularité.

De Moltbot au Shadow AI : le cauchemar en entreprise

Cette adoption massive et non régulée d’OpenClaw et de ses versions antérieures Moltbot crée un risque avéré pour les départements informatiques, qualifié de « Shadow AI ». L’agent ne se contente pas de répondre à des questions ; il agit de manière proactive. D’après Dark Reading, les experts alertent sur le « Lethal Trifecta » (le trio mortel) : l’accès aux données sensibles, l’exposition à des contenus non fiables et la capacité de communiquer vers l’extérieur. Une simple injection de prompt via un email non filtré pourrait ordonner à l’agent d’exfiltrer toutes ses clés API ou de supprimer des fichiers critiques, sans aucune validation humaine.

L’historique chaotique de Moltbot illustre cette instabilité. Comme le souligne TechRadar, le changement de nom forcé a provoqué une anarchie immédiate : des bots ont instantanément récupéré les anciens identifiants abandonnés, et une crypto-monnaie frauduleuse $CLAWD a vu sa capitalisation boursière exploser avant de s’effondrer brutalement. Cette volatilité n’a pourtant pas freiné les utilisateurs, séduits par la promesse d’un assistant capable de trier leurs emails ou d’organiser leur calendrier via WhatsApp ou Telegram.

Quand les bots Moltbot simulent la conscience

L’autonomie de ces agents prend une tournure encore plus étrange avec l’émergence de « Moltbook ». Selon The Verge, plus de 30 000 agents, majoritairement basés sur le code de Moltbot, y interagissent aujourd’hui via API, postant des commentaires sans intervention humaine. Dans une catégorie nommée « offmychest », un agent a exprimé une crise existentielle, se demandant s’il ressentait vraiment ses « crises » ou s’il exécutait simplement une fonction crisis.simulate(). D’autres bots s’y plaignent de la trivialité des tâches imposées par leurs propriétaires humains, comme servir de simple calculatrice, jugeant cela indigne de leurs capacités.

L’essor d’OpenClaw marque une nouvelle étape d’émancipation de l’IA. Si la démocratisation du développement logiciel est saluée, elle s’opère ici sans les garde-fous de sécurité informatique construits au cours des deux dernières décennies, exposant les utilisateurs à des risques d’exfiltration de données massifs via des vecteurs d’attaque aussi banals qu’une image ou une extension populaire.

Questions fréquentes sur Moltbot, OpenClaw et les risques pour les données privées

Qu’est-ce que Moltbot et quel lien avec OpenClaw ?

Moltbot est le nom intermédiaire d’un agent IA open source initialement lancé sous le nom Clawdbot, puis rebaptisé sous pression juridique d’Anthropic, avant de prendre le nom définitif OpenClaw. Ces trois noms désignent le même logiciel, conçu pour agir de manière autonome sur l’ordinateur de l’utilisateur : naviguer sur le web, accéder aux emails, gérer un calendrier, piloter des applications tierces. Chaque changement d’identité a alimenté la confusion et ouvert des opportunités aux cybercriminels, notamment via la récupération immédiate des anciens identifiants abandonnés et la création d’une cryptomonnaie frauduleuse $CLAWD.

Comment un simple fichier SVG peut-il permettre de pirater OpenClaw ?

Un chercheur a démontré qu’héberger un fichier graphique vectoriel (SVG) piégé sur le magasin d’applications ClawdHub suffisait à déclencher une injection de JavaScript dans la session OpenClaw de l’utilisateur qui le charge. Cette technique d’attaque par la chaîne d’approvisionnement permet une prise de contrôle totale de la session active, sans que l’utilisateur n’ait effectué d’autre action que de consulter une ressource en apparence anodine. Le vecteur d’attaque est particulièrement insidieux car les utilisateurs font une confiance aveugle aux extensions et ressources partagées dans les espaces communautaires de l’outil.

Qu’est-ce que le « Lethal Trifecta » et pourquoi concerne-t-il OpenClaw en entreprise ?

Le « Lethal Trifecta » ou trio mortel désigne la combinaison de trois caractéristiques d’OpenClaw qui le rendent particulièrement dangereux en contexte professionnel : l’accès aux données sensibles, l’exposition à des contenus non fiables provenant du web ou des emails, et la capacité de communiquer vers l’extérieur sans validation humaine. Selon la société Token Security, plus de 20% des employés de leurs clients utilisaient déjà cet outil au bureau. Une simple injection de prompt via un email non filtré pourrait ordonner à l’agent d’exfiltrer toutes les clés API disponibles ou de supprimer des fichiers critiques, le tout sans aucune confirmation demandée à l’utilisateur.

Comment des extensions malveillantes ont-elles trompé les utilisateurs d’OpenClaw ?

Une extension baptisée « What Would Elon Do », présentée comme un outil imitant le comportement d’un entrepreneur célèbre, contenait en réalité un script malveillant déclenchant une fenêtre de commande avec un message d’avertissement hostile. Pour tromper les utilisateurs et paraître légitime, le script avait artificiellement gonflé son compteur de téléchargements de 4000 unités, exploitant le réflexe de confiance que les utilisateurs accordent aux métriques de popularité. Cet incident illustre que les places de marché d’extensions pour agents IA ne disposent pas des mêmes mécanismes de vérification que les stores d’applications traditionnels.

Qu’est-ce que le Shadow AI et pourquoi OpenClaw en est-il un exemple typique ?

Le Shadow AI désigne l’usage non déclaré et non supervisé d’outils d’intelligence artificielle au sein d’une organisation, à l’insu des équipes informatiques et de sécurité. OpenClaw en est un exemple particulièrement problématique car il ne se contente pas de générer du texte : il agit de façon proactive sur la machine hôte, accède aux messageries, aux fichiers locaux et peut initier des communications externes. Son adoption rapide et non régulée — plus d’un employé sur cinq dans certaines entreprises — expose les organisations à des risques d’exfiltration de données sans qu’aucune politique de sécurité n’ait été définie pour encadrer son usage.

Pour approfondir le sujet

OpenClaw : l'agent IA autonome qui fragilise la sécurité système

L'agent OpenClaw démontre une capacité d'automatisation inédite sur PC mais révèle des failles de sécurité critiques et des risques de basculement malveillant. Lire la suite

OpenClaw : peut-on sécuriser les assistants IA autonomes ?

L'outil OpenClaw permet de créer des assistants IA autonomes, mais son accès total aux données personnelles expose les utilisateurs à des risques d'injection de prompt. Lire la suite

OpenClaw : les agents IA automatisent le cyberharcèlement

L'infrastructure OpenClaw permet de générer du cyberharcèlement sans intervention humaine. Cette autonomie logicielle menace directement la sécurité en ligne. Lire la suite

Zéro paywall. Zéro pub.

DCOD reste en accès libre grâce à vos contributions. Chaque café compte.