TL;DR : L’essentiel

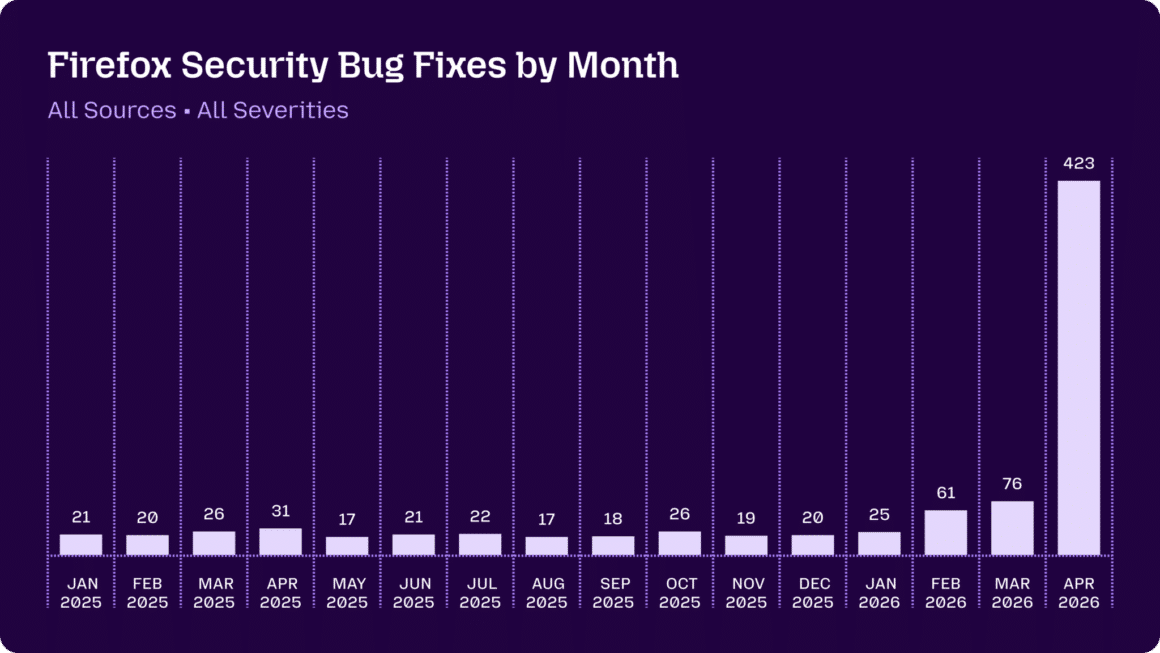

- Les équipes de sécurité ont corrigé 423 vulnérabilités durant le mois d’avril grâce à l’usage de modèles d’intelligence artificielle spécialisés. Ce volume de réparations est près de 20 fois supérieur à la moyenne mensuelle enregistrée l’année précédente.

- Le nouveau modèle Claude Mythos a identifié des erreurs de code latentes depuis plus de 15 ans. Ces failles concernent des mécanismes sensibles comme le traitement des éléments HTML et l’interprétation des données par le navigateur.

- L’outil parvient à simuler des attaques complexes pour s’extraire des zones sécurisées du logiciel. Cette capacité d’analyse dépasse désormais les méthodes de tests automatisés par injection de données, aussi appelées fuzzing.

- L’avantage structurel des attaquants s’érode à mesure que les défenseurs automatisent la recherche de défauts. La vitesse de détection devient le facteur clé pour sécuriser les infrastructures logicielles modernes face aux menaces émergentes.

L’IA contraint désormais le secteur de la cybersécurité à une nouvelle vitesse pour gérer les vulnérabilités et protéger les logiciels critiques. En avril, les systèmes de défense de Firefox ont enregistré un pic d’activité avec la résolution de 423 défauts de sécurité. Cette performance repose sur l’utilisation de modèles de langage capables de raisonner sur le code source avec une précision comparable à celle d’un expert. Selon le Blog de Mozilla, l’écart technologique entre les outils automatiques et l’expertise manuelle est en train de disparaître.

Claude Mythos : une analyse chirurgicale des codes anciens

L’introduction de modèles comme Claude Mythos transforme la traque aux vulnérabilités en un processus rapide. Le système a ainsi mis au jour une erreur de logique présente depuis 15 ans dans la manière dont le logiciel traite certains éléments de structure des pages web. Cette faille permettait à un attaquant de manipuler le rendu du navigateur pour compromettre la sécurité. L’ingénieur émérite en charge du projet précise dans TechCrunch que le volume de détection actuel dépasse largement ce que les chercheurs humains parvenaient à produire.

L’intelligence artificielle ne se contente pas de lire le texte des programmes informatiques. Elle exécute des simulations pour vérifier si une ligne de code peut réellement servir de porte d’entrée à une intrusion. Comme l’explique le site Mozilla Hacks, le modèle peut créer des cas de tests reproductibles pour valider ses propres hypothèses. Cette méthode a permis de neutraliser une faille de 20 ans située dans une interface de programmation utilisée pour la transformation de documents complexes.

L'essentiel Cybersécurité, IA & Tech

Rejoignez la communauté. 3 fois par semaine, recevez l'analyse des tendances par Marc Barbezat. Pas de spam, juste de l'info.

Le harnais d’agents : automatiser la traque aux intrusions

La réussite de cette campagne de sécurisation devrait s’appuyer sur la création d’un dispositif de pilotage appelé harnais d’agents. Ce mécanisme sert d’intermédiaire entre l’intelligence artificielle et le code du navigateur pour filtrer les résultats et éliminer les fausses alertes. Selon les analyses de The Register, cette structure permet de multiplier les recherches en parallèle sur de nombreux fichiers simultanément. Les experts peuvent alors se concentrer sur la validation et l’écriture des correctifs.

Cette puissance de calcul cible prioritairement les évasions de bac à sable, ou sandbox. Ce dispositif de sécurité isole chaque site web pour l’empêcher d’accéder aux données privées stockées sur l’ordinateur. L’IA parvient à identifier des chemins complexes pour briser cette isolation, une tâche qui exigeait autrefois des recherches manuelles très longues. Les journaux d’audit révèlent que l’outil tente des manœuvres sophistiquées, comme le déclenchement de débordements de mémoire, pour prouver l’existence d’un danger réel.

Une course contre la montre face aux futures menaces

L’accélération de la détection grâce à l’IA impose de s’assurer de l’efficacité des processus actifs face à une avalanche imminente et prévisible de vulnérabilités critiques. Le volume de bugs identifiés risque de devenir si important que les entreprises devront adapter leurs cycles de mise à jour. Le rythme des corrections est devenu environ 5 fois plus élevé que durant le mois précédent, selon les statistiques sur ce périmètre de Firefox.

La vitesse de correction devient le rempart principal contre les acteurs malveillants équipés d’outils d’analyse similaires. Une réduction drastique du délai entre la découverte et le correctif limite les opportunités d’exploitation. Les équipes en charge de l’exploitation et de la maintenance doivent anticiper un flux massif de signalements. Chaque organisation ne doit laisser aucune fenêtre de tir aux attaquants.

L’expérimentation menée sur Firefox démontre que l’automatisation intelligente peut purger des logiciels de leurs failles les plus anciennes. Il faut maintenant se préparer à la course au patching pour maintenir la sécurité des systèmes d’information.

Comprendre l’impact de l’IA sur la détection des failles

Quel est le bilan des vulnérabilités découvertes par l’intelligence artificielle ?

L’intelligence artificielle a identifié 271 vulnérabilités spécifiques pour la version 150 du navigateur. La majorité de ces défauts, soit 180 cas, présentait un niveau de risque élevé pour la sécurité des systèmes. Les découvertes incluent principalement des évasions de zones sécurisées et des erreurs de gestion de la mémoire restées cachées dans le code source depuis plus de quinze ans.

Comment le nombre de failles identifiées a-t-il évolué avec ce saut technologique ?

Le volume de corrections mensuelles a connu une progression spectaculaire en seulement un an. En avril, les équipes techniques ont traité 423 failles, contre seulement 31 durant la même période l’année précédente. Cette nouvelle capacité de détection représente un rythme de réparation environ vingt fois supérieur à la moyenne mensuelle habituelle enregistrée par l’éditeur.

Pourquoi l’IA est-elle plus efficace que les anciens outils de détection ?

Les outils classiques utilisaient souvent des règles fixes pour chercher des erreurs. L’intelligence artificielle actuelle peut comprendre la logique complexe d’un programme et anticiper comment différentes parties du code interagissent entre elles pour créer une vulnérabilité exploitable.

Pourquoi l’accélération des processus de correction est-elle vitale ?

L’automatisation de la détection génère un volume de signalements sans précédent qui sature les méthodes de gestion traditionnelles. Sans une révision profonde des processus de déploiement, les équipes techniques risquent d’être submergées par cette avalanche de données critiques et de perdre en efficacité.

Pour approfondir le sujet

Claude Mythos identifié comme trop risqué pour un accès public

Claude Mythos Preview ne sera pas publié : 50 organisations testent ses capacités de détection de zero-days avant tout déploiement élargi. Lire la suite

Claude Mythos détaillé : l'IA d'Anthropic qui crée des exploits

Une fuite révèle Claude Mythos, le futur modèle d'Anthropic. Capable d'exploiter des failles critiques, cette IA inquiète les experts en sécurité. Lire la suite

GPT-5.4-Cyber : OpenAI tente de rattraper Anthropic sur la cybersécurité

OpenAI déploie GPT-5.4-Cyber pour concurrencer Anthropic, devenu le leader de la sécurisation du code et de la détection de vulnérabilités logicielles. Lire la suite

Serveurs, API, temps de veille...

DCOD est indépendant et sans revenus. Soutenez le site pour l'aider à couvrir ses frais techniques.